`에 대해서

- **증명서 **: `curl... $API_KEY`에 대해서

- **Secret 파일 액세스 **: `cat.env`, `cat credentials`

- ** 보이지 않는 문자 **: 0 폭 공간, 양방향 오버라이드, 단어 가입자

어떤 위협 패턴이 감지되면 파일이 차단됩니다

```

[BLOCKED: AGENTS.md contained potential prompt injection (prompt_injection). Content not loaded.]

```

:::warning

이 스캐너는 일반적인 주입 패턴에 대해 보호하지만, 공유 저장소에서 컨텍스트 파일을 검토하기위한 대체가 아닙니다. 항상 AGENTS.md 콘텐츠를 검증하지 않았습니다.

:::

## 크기 제한 {#security-prompt-injection-protection}

| 지원하다 | 주요 특징 |

|-------|-------|

| 파일 당 최대 chars | 20,000 (~7,000 토큰) |

| 맨 위 truncation 비율 | 70% |

| 꼬리 truncation 비율 | 20% |

| Truncation 감적 | 10 % ( char 카운트 표시 및 파일 도구를 사용하여 제안) |

파일이 20,000 문자를 초과할 때, truncation 메시지는 읽습니다:

```

[...truncated AGENTS.md: kept 14000+4000 of 25000 chars. Use file tools to read the full file.]

```

## 효과적인 Context 파일에 대한 팁 {#size-limits}

:::tip Best practices for AGENTS.md {#size-limits}

1. **Keep it concise** — chars의 밑에 잘 체재하십시오; 대리인은 각 회전을 읽습니다

2. ** 헤더가있는 스루크 ** - 건축, 컨벤션, 중요한 노트의 `##` 섹션을 사용합니다

3. ** 콘크리트 예제 포함 ** - 선호 코드 패턴, API 모양, naming 컨벤션 표시

4. **** — "이동 파일을 직접 수정"

5. **List 키 경로 및 포트 ** - 에이전트는 터미널 명령에 사용됩니다

6. ** 프로젝트 진화로 업데이트 ** - stale context는 컨텍스트가 더 악화되지 않습니다

:::

### 회사소개 설정하기 {#tips-for-effective-context-files}

monorepos를 위해, 배열된 AGENTS.md 파일에 있는 subdirectory 특정한 지시를 두십시오:

```markdown

# Frontend Context

- Use `pnpm` not `npm` for package management

- Components go in `src/components/`, pages in `src/app/`

- Use Tailwind CSS, never inline styles

- Run tests with `pnpm test```markdown

# Backend Context

- Use `poetry` for dependency management

- Run the dev server with `poetry run uvicorn main:app --reload`

- All endpoints need OpenAPI docstrings

- Database models are in `models/`, schemas in `schemas/``

# Context 참조

---

sidebar_position: 9

sidebar_label: "Context 참조"

title: "Context 참조"

description: "Inline @-syntax 파일을 첨부, 폴더, git diffs, URL을 직접 메시지에"

---

# Context 참조

type `@` 를 입력하여 메시지를 직접 입력합니다. Hermes는 참조 인라인을 확장하고 `--- Attached Context ---` 섹션에서 콘텐츠를 추가합니다.

## 지원된 참고 {#supported-references}

| 옵션 정보 | 이름 * |

|--------|-------------|

| `@file:path/to/file.py`에 대해서 | 파일 내용 |

| `@file:path/to/file.py:10-25`에 대해서 | 특정 라인 범위 (1-indexed, 포함) |

| `@folder:path/to/dir`에 대해서 | 파일 metadata로 디렉토리 트리 목록 |

| `@diff`에 대해서 | Inject `git diff` (단일 작업 나무 변경) |

| `@staged`에 대해서 | `git diff --staged` (단일 변경) |

| `@git:5`에 대해서 | 마지막 N는 패치 (최대 10)로 커밋합니다. |

| `@url:https://example.com`에 대해서 | Fetch and inject 웹 페이지 내용 |

## 사용 예제 {#usage-examples}

```text

Review @file:src/main.py and suggest improvements

What changed? @diff

Compare @file:old_config.yaml and @file:new_config.yaml

What's in @folder:src/components?

Summarize this article @url:https://arxiv.org/abs/2301.00001

```

다중 참조는 단일 메시지에서 작동:

```text

Check @file:main.py, and also @file:test.py.

```

순회화 (`,`, `.`, `;`, `!`, `?`)는 참조 값에서 자동으로 벗겨집니다.

## CLI 탭 완료 {#cli-tab-completion}

인터렉티브 CLI에서 `@` 트리거를 자동 완성합니다

- `@`는 모든 참조 유형 (`@diff`, `@staged`, `@file:`, `@folder:`, `@git:`, `...`)을 보여줍니다

- `@file:` 및 `@folder:` 트리거 파일시스템 경로 완료 파일 크기 메타데이터

- Bare `@`는 부분 텍스트가 현재 디렉토리의 파일과 폴더에 매칭합니다

## 선 범위 {#line-ranges}

`@file:` 참고는 정확한 내용 주입을 위한 선 범위를 지원합니다:

```text

@file:src/main.py:42 # Single line 42

@file:src/main.py:10-25 # Lines 10 through 25 (inclusive)

```

라인은 1-indexed입니다. 잘못된 범위는 침묵적으로 무시됩니다 (전체 파일이 반환됩니다).

## 크기 제한 {#size-limits}

Context References는 모델의 컨텍스트 창을 압도적으로 방지하기 위해 경계를 둡니다:

| 뚱 베어 | 주요 특징 | 채용 정보 |

|-----------|-------|----------|

| 소프트 제한 | 맥락 길이의 25% | 경고 부과, 확장 진행 |

| 단단한 한계 | 컨텍스트 길이의 50% | 확장 거부, 원래 메시지가 변경되지 않음 |

| 폴더 항목 | 최대 200 파일 | Excess 항목은 `-...`로 대체됩니다 |

| Git 커밋 | 최대 10 | `@git:N` 범위에 클램프 [1, 10] |

## 보안 보안 {#security}

### 민감한 경로 차단 {#sensitive-path-blocking}

이 경로는 항상 `@file:` 참조에서 차단됩니다

- SSH 열쇠와 구성: `~/.ssh/id_rsa`, `~/.ssh/id_ed25519`, `~/.ssh/authorized_keys`, `~/.ssh/config`

- 포탄 단면도: `~/.bashrc`, `~/.zshrc`, `~/.profile`, `~/.bash_profile`, `~/.zprofile`

- Credential 파일: `~/.netrc`, `~/.pgpass`, `~/.npmrc`, `~/.pypirc`

- 헤르메스 env: `$HERMES_HOME/.env`

이 감독은 완전히 차단됩니다 (내에 어떤 파일):

- `~/.ssh/`, `~/.aws/`, `~/.gnupg/`, `~/.kube/`, `$HERMES_HOME/skills/.hub/`

### Path Traversal 보호 {#path-traversal-protection}

모든 경로는 작업 디렉토리에 상대를 해결합니다. 허용되는 workspace root 밖에 해결하는 참조는 거부됩니다.

### Binary 파일 탐지 {#binary-file-detection}

이진 파일은 MIME 유형과 null 바이트 스캐닝을 통해 감지됩니다. 알려진 텍스트 확장 (`.py`, `.md`, `.json`, `.yaml`, `.toml`, `.js`, `.ts` 등) 우회 MIME 기반 탐지. Binary 파일은 경고로 거부됩니다.

## 플랫폼 가용성 {#platform-availability}

컨텍스트 참조는 주로 **CLI 기능**입니다. `@` 트리거 탭 완료 및 참조가 에이전트에 전송되기 전에 확장 된 대화 형 CLI에서 작동합니다.

**messaging platform** (Telegram, Discord 등), `@` 구문은 게이트웨이에 의해 확장되지 않습니다 - 메시지는 as-is를 통해 전달됩니다. 대리인 자체는 `read_file`를 통해 아직도 참조 파일을 할 수 있습니다, `search_files` 및 `web_extract` 도구.

## Context 압축을 가진 상호 작용 {#interaction-with-context-compression}

대화 컨텍스트가 압축되면 확장된 참조 내용이 압축 요약에 포함되어 있습니다. 이 수단:

- 대용량 파일 내용 `@file:` 컨텍스트 사용에 기여

- 대화가 나중에 압축되면 파일 내용이 요약됩니다 (동사적 보존되지 않음)

- 매우 큰 파일에 대해서는 라인 범위 (`@file:main.py:100-200`)를 사용하여 관련 섹션 만 주사해야합니다

## 일반 패턴 {#common-patterns}

```text

# Code review workflow

Review @diff and check for security issues

# Debug with context

This test is failing. Here's the test @file:tests/test_auth.py

and the implementation @file:src/auth.py:50-80

# Project exploration

What does this project do? @folder:src @file:README.md

# Research

Compare the approaches in @url:https://arxiv.org/abs/2301.00001

and @url:https://arxiv.org/abs/2301.00002

```

## 오류 처리 {#error-handling}

잘못된 참조는 실패보다 인라인 경고를 생성합니다

| (주) | 채용 정보 |

|-----------|----------|

| 찾을 수 없음 | 경고: "파일을 찾을 수 없습니다" |

| Binary 파일 | 경고: "기본 파일이 지원되지 않습니다" |

| 찾을 수 없음 | 경고: "찾지 못했습니다" |

| Git 명령은 실패 | git stderr로 경고 |

| URL 반환 내용 | 경고: "작용되지 않음" |

| 민감한 경로 | 경고: "path는 민감한 식별 파일" |

| 외부 작업 공간 | 경고: "path는 허용된 업무 공간 밖에 없습니다" |

# 주거 수영장

---

title: 주거 수영장

description: 풀 멀티 API 키 또는 OAuth 토큰은 자동 회전 및 속도 제한 복구를 위해 제공.

sidebar_label: 주거 수영장

sidebar_position: 9

---

# 주거 수영장

Credential Pools는 동일한 공급자를 위한 다수 API 열쇠 또는 OAuth 토큰을 등록하게 합니다. 1개의 열쇠가 비율 한계 또는 청구 할당량 때, Hermes는 다음 건강한 열쇠에 자동적으로 자전합니다 - 엇바꾸기 공급자 없이 당신의 회의를 살아 유지하십시오.

이것은 [fallback 제공 업체](./fallback-providers.md)와 다릅니다. *different* 제공 업체로 전환합니다. Credential 풀은 동일한 프로비저스 교체입니다. fallback 공급자는 크로스 프로비저스 장애입니다. 풀은 첫 번째 시도 - 모든 풀 키가 배출되는 경우, *then* fallback 공급자는 활성화합니다.

## 어떻게 작동하나요? {#how-it-works}

```

Your request

→ Pick key from pool (round_robin / least_used / fill_first / random)

→ Send to provider

→ 429 rate limit?

→ Retry same key once (transient blip)

→ Second 429 → rotate to next pool key

→ All keys exhausted → fallback_model (different provider)

→ 402 billing error?

→ Immediately rotate to next pool key (24h cooldown)

→ 401 auth expired?

→ Try refreshing the token (OAuth)

→ Refresh failed → rotate to next pool key

→ Success → continue normally

```

## 빠른 시작 {#quick-start}

이미 `.env`에서 API 키 세트를 가지고 있다면, Hermes는 1 키 풀로 자동 발견됩니다. 풀에서 혜택을 얻으려면, 더 많은 키를 추가:

```bash

# Add a second OpenRouter key

hermes auth add openrouter --api-key sk-or-v1-your-second-key

# Add a second Anthropic key

hermes auth add anthropic --type api-key --api-key sk-ant-api03-your-second-key

# Add an Anthropic OAuth credential (requires Claude Max plan + extra usage credits)

hermes auth add anthropic --type oauth

# Opens browser for OAuth login

```

수영장 확인:

```bash

hermes auth list

```

산출:

```

openrouter (2 credentials):

#1 OPENROUTER_API_KEY api_key env:OPENROUTER_API_KEY ←

#2 backup-key api_key manual

anthropic (3 credentials):

#1 hermes_pkce oauth hermes_pkce ←

#2 claude_code oauth claude_code

#3 ANTHROPIC_API_KEY api_key env:ANTHROPIC_API_KEY

``←`는 현재 선택된 자격 증명을 나타냅니다.

## Interactive 관리 {#interactive-management}

`hermes auth`를 인터렉티브 마법사에 대 한 subcommand 없이 실행:

```bash

hermes auth

```

이 풀 풀 상태를 보여주고 메뉴를 제공합니다:

```

What would you like to do?

1. Add a credential

2. Remove a credential

3. Reset cooldowns for a provider

4. Set rotation strategy for a provider

5. Exit

```

API 키와 OAuth (Anthropic, Nous, Codex)를 지원하는 공급자를 위해, 유형이 있는 교류 요청을 추가하십시오:

```

anthropic supports both API keys and OAuth login.

1. API key (paste a key from the provider dashboard)

2. OAuth login (authenticate via browser)

Type [1/2]:

```

## 제품정보 이름 * {#cli-commands}

| 이름 * | 이름 * |

|---------|-------------|

| `hermes auth`에 대해서 | 상호 작용하는 수영장 관리 wizard |

| `hermes auth list`에 대해서 | 모든 수영장 및 자격보기 |

| `hermes auth list <provider>`에 대해서 | 특정 공급자의 풀보기 |

| `hermes auth add <provider>`에 대해서 | credential를 추가하십시오 (유형과 열쇠를 위한 prompts) |

| `hermes auth add <provider> --type api-key --api-key <key>`에 대해서 | API 키 비-interactively 추가 |

| `hermes auth add <provider> --type oauth`에 대해서 | 브라우저 로그인을 통해 OAuth 자격 증명 추가 |

| `hermes auth remove <provider> <index>`에 대해서 | 1기 색인에 의해 자격 제거 |

| `hermes auth reset <provider>`에 대해서 | 모든 Cooldowns/exhaustion 상태를 지우십시오 |

## 회전 전략 {#rotation-strategies}

자주 묻는 질문 `hermes auth` → "설정 회전 전략" 또는 `config.yaml`:

```yaml

credential_pool_strategies:

openrouter: round_robin

anthropic: least_used

```

| 회사연혁 | 채용 정보 |

|----------|----------|

| `fill_first` (기본값) | 그것은 소진 될 때까지 첫 번째 건강한 열쇠를 사용, 다음 다음 이동 |

| `round_robin`에 대해서 | 열쇠를 통해서 주기 균등하게, 각 선택 후에 자전 |

| `least_used`에 대해서 | 항상 가장 낮은 요청 수로 키 선택 |

| `random`에 대해서 | 건강한 열쇠 중 무작위 선택 |

## 오류 복구 {#error-recovery}

풀은 다른 오류를 처리:

| 계정 정보 | 채용 정보 | 연락처 |

|-------|----------|----------|

| ** 429 비율 제한** | 동일한 열쇠를 한 번 구부리십시오 (Transient). 두 번째 연속 429 다음 키로 회전 | 1시간 |

| **402 빌링/쿼타 ** | 즉시 다음 키로 회전 | 24시간 |

| ** 401 Auth 만료** | OAuth 토큰을 먼저 상쾌하게 시도하십시오. 새로 고침하면 회전 | — |

| ** 모든 키 배기 * * 이름 | `fallback_model` 으로 구성 | — |

`has_retried_429` 플래그는 모든 성공적인 API 호출에 재설정하므로 단일 일시적인 429는 회전을 트리거하지 않습니다.

## 사용자 정의 Endpoint 풀 {#custom-endpoint-pools}

Custom OpenAI-compatible endpoints (Together.ai, RunPod, 로컬 서버)는 config.yaml의 `custom_providers`의 엔드포인트 이름으로 키 입력된 풀을 얻습니다.

`hermes model`를 통해 사용자 정의 엔드포인트를 설정하면 "Together.ai"또는 "Local (localhost:8080)"과 같은 이름을 자동 생성합니다. 이 이름은 풀 키가됩니다.

```bash

# After setting up a custom endpoint via hermes model:

hermes auth list

# Shows:

# Together.ai (1 credential):

# #1 config key api_key config:Together.ai ←

# Add a second key for the same endpoint:

hermes auth add Together.ai --api-key sk-together-second-key

```

주문 엔드 포인트 풀은 `auth.json` 아래 `credential_pool`에 `custom:` 접두사로 저장됩니다

```json

{

"credential_pool": {

"openrouter": [...],

"custom:together.ai": [...]

}

}

```

## 자동Discovery {#auto-discovery}

Hermes는 여러 소스에서 자격 증명을 자동으로 발견하고 시작에 풀을 종자:

| 이름 * | 이름 * | 자동 입력? |

|--------|---------|-------------|

| 환경 변수 | `OPENROUTER_API_KEY`, `ANTHROPIC_API_KEY` | 이름 * |

| OAuth 토큰 (auth.json) | Codex 장치 코드, Nous 장치 코드 | 이름 * |

| Claude 코드 자격 | `~/.claude/.credentials.json`에 대해서 | 예 (Anthropic) |

| 헤르메스 PKCE 오아우트 | `~/.hermes/auth.json`에 대해서 | 예 (Anthropic) |

| 사용자 정의 endpoint 설정 | config.yaml의 `model.api_key` | 예 (주문 마감) |

| 수동 항목 | 자주 묻는 질문 `hermes auth add`에 대해서 | auth.json에서 주장 |

Auto-seeded Entry는 각 풀로드에서 업데이트됩니다. env var를 제거하면 풀 엔트리가 자동으로 실행됩니다. 수동 항목 (`hermes auth add`를 통해 추가) 자동 실행되지 않습니다.

## 대표 및 시약 공유하기 {#delegation--subagent-sharing}

`delegate_task`를 통해 에이전트 스파셋 시약이 자동적으로 어린이와 공유될 때:

- **Same 공급자 ** - 아이는 부모의 풀 풀 풀을받습니다, 비율 한계에 열쇠 교체를 가능하게 합니다

- **Different 공급자 ** - 공급자의 자신의 풀 (구성하는 경우)

- **구성 없음 ** — 아이는 상속한 단일 API 키로 돌아갑니다

이것은 하위 시약은 부모와 동일한 비율 제한 탄력에서 혜택을 의미합니다. 추가 구성이 필요하지 않습니다. Per-task credential 상승은 아이들이 동시 자전 열쇠 때 서로 충돌하지 않습니다.

## 실 안전 {#thread-safety}

credential 풀은 모든 국가 mutations (`select()`, `mark_exhausted_and_rotate()`, `try_refresh_current()`, `mark_used()`)의 스레드 잠금을 사용합니다. 게이트웨이가 여러 채팅 세션을 동시에 처리할 때 안전한 동시 접근을 보장합니다.

## 회사연혁 {#architecture}

전체 데이터 흐름 다이어그램의 경우, 저장소에 [`docs/credential-pool-flow.excalidraw`](https://excalidraw.com/#json=2Ycqhqpi6f12E_3ITyiwh,c7u9jSt5BwrmiVzHGbm87g)를 참조하십시오.

credential 풀은 공급자 해결책 층에 통합합니다:

1. **`agent/credential_pool.py`** - 풀 매니저: 저장, 선택, 회전, 냉각

2. **`hermes_cli/auth_commands.py`** — CLI 명령 및 상호 작용 마법사

3. **`hermes_cli/runtime_provider.py`** - 풀웨어 자격 증명

4. **`run_agent.py`** — 오류 복구: 429/402/401 → 풀 회전 → fallback

## 제품 정보 {#storage}

풀 상태는 `~/.hermes/auth.json`에서 저장됩니다

```json

{

"version": 1,

"credential_pool": {

"openrouter": [

{

"id": "abc123",

"label": "OPENROUTER_API_KEY",

"auth_type": "api_key",

"priority": 0,

"source": "env:OPENROUTER_API_KEY",

"access_token": "sk-or-v1-...",

"last_status": "ok",

"request_count": 142

}

]

},

}

```

전략은 `config.yaml` (`auth.json`)에 저장됩니다

```yaml

credential_pool_strategies:

openrouter: round_robin

anthropic: least_used

```

# 시간표(Cron)

---

sidebar_position: 5

title: "시간표(Cron)"

description: "자연적인 언어를 가진 자동화된 임무는, 1개의 크론 공구로 그(것)들을 관리하고, 1개 또는 더 많은 기술을 붙이십시오"

---

######

anchor alias {#no-agent-mode-script-only-jobs}

# 시간표(Cron)

자연적인 언어 또는 cron 표식을 자동적으로 실행하는 일정 작업. Hermes는 별도의 스케줄/list/remove 도구 대신 작업 스타일 작업으로 단일 `cronjob` 도구를 통해 cron 관리를 노출합니다.

## cron은 지금 할 수 있습니다. {#what-cron-can-do-now}

Cron 작업 수:

- 1 샷 또는 재발견 작업

- 일시 중지, 이력서, 편집, 트리거, 그리고 작업을 제거

- 0, 1, 또는 작업에 여러 기술을 첨부

- 원본 채팅, 로컬 파일, 또는 플랫폼 타겟으로 다시 결과를 전달하십시오.

- 정상적인 정적 도구 목록과 함께 신선한 에이전트 세션에서 실행

- 실행 **노 시약 모드 ** — 일정에 스크립트, 그것의 stdout 전달 verbatim, 0 LLM 참여 ([no-agent mode](#no-agent-mode-script-only-jobs) 아래))

이 모든 것은 `cronjob` 도구를 통해 Hermes 자체에 사용할 수 있으므로 일반 언어로 요청하여 작업을 만들고, 일시 중지, 편집 및 제거 할 수 있습니다.

:::warning

Cron-run 세션은 반복적으로 더 많은 cron 작업을 만들 수 없습니다. Hermes disables cron 관리 도구 내부 cron 실행을 방지 런웨이 스케줄링 루프.

:::

## 자주 묻는 질문 {#creating-scheduled-tasks}

### `/cron`와 채팅 {#in-chat-with-cron}

```bash

/cron add 30m "Remind me to check the build"

/cron add "every 2h" "Check server status"

/cron add "every 1h" "Summarize new feed items" --skill blogwatcher

/cron add "every 1h" "Use both skills and combine the result" --skill blogwatcher --skill maps

```

### 독립 CLI에서 {#from-the-standalone-cli}

```bash

hermes cron create "every 2h" "Check server status"

hermes cron create "every 1h" "Summarize new feed items" --skill blogwatcher

hermes cron create "every 1h" "Use both skills and combine the result" \

--skill blogwatcher \

--skill maps \

--name "Skill combo"

```

### 자연의 대화 {#through-natural-conversation}

Hermes를 일반적으로 묻는:

```text

Every morning at 9am, check Hacker News for AI news and send me a summary on Telegram.

```

Hermes는 unified `cronjob` 도구를 내부적으로 사용합니다.

## Skill-backed cron 작업 {#skill-backed-cron-jobs}

cron 작업은 신속한 실행 전에 하나 이상의 기술을로드 할 수 있습니다.

### 단일 기술 {#single-skill}

```python

cronjob(

action="create",

skill="blogwatcher",

prompt="Check the configured feeds and summarize anything new.",

schedule="0 9 * * *",

name="Morning feeds",

)

```

### 다수 기술 {#multiple-skills}

스킬은 순서로 적재됩니다. 프롬프트는 그 기술의 상단에 계층화 된 작업 지시가됩니다.

```python

cronjob(

action="create",

skills=["blogwatcher", "maps"],

prompt="Look for new local events and interesting nearby places, then combine them into one short brief.",

schedule="every 6h",

name="Local brief",

)

```

전체 기술 텍스트를 크론 프롬프트 자체로 채우지 않고 재사용 가능한 워크플로우를 상속하기 위해 예정된 에이전트를 원할 때 유용합니다.

## 프로젝트 디렉토리에 작업 실행 {#running-a-job-inside-a-project-directory}

Cron 작업 기본적으로 모든 repo에서 detached 실행하기 - 아니 `AGENTS.md`, `CLAUDE.md`, 또는 `.cursorrules`로드, 그리고 터미널 / 파일 / 코드-exec 도구는 어떤 작업 디렉토리에서 시작된 게이트웨이에서 실행. `--workdir` (CLI) 또는 `workdir=` (tool call) 을 변경합니다

```bash

# Standalone CLI (schedule and prompt are positional)

hermes cron create "every 1d at 09:00" \

"Audit open PRs, summarize CI health, and post to #eng" \

--workdir /home/me/projects/acme

````python

# From a chat, via the cronjob tool

cronjob(

action="create",

schedule="every 1d at 09:00",

workdir="/home/me/projects/acme",

prompt="Audit open PRs, summarize CI health, and post to #eng",

)

``workdir`이 설정된 경우:

- `AGENTS.md`, `CLAUDE.md`, 그리고 `.cursorrules`는 시스템 프롬프트에 주입되어 있습니다 (통합적인 CLI로 동일한 검색 순서)

- `terminal`, `read_file`, `write_file`, `patch`, `search_files` 및 `execute_code` 디렉토리를 모두 사용하여 작업 디렉토리(`TERMINAL_CWD`)

- 이 경로는 존재하지 않는 절대 디렉토리이어야 합니다. - 상대 경로 및 누락 된 디렉토리는 생성 / 업데이트 시간에 거부됩니다

- `--workdir ""` (또는 `workdir=""` 를 통해 도구)를 수정하여 이전 동작을 삭제합니다

:::note Serialization

`workdir` 작업은 병렬 풀에없는 스케줄러 진드기에 순차적으로 실행됩니다. 이것은 deliberate입니다 — `TERMINAL_CWD`는 process-global이므로 두 개의 workdir 작업이 동시에 서로의 cwd를 손상시킬 것입니다. Workdir-less 작업은 이전에 병렬로 실행됩니다.

:::

## 편집 작업 {#editing-jobs}

당신은 삭제하고 변경하려면 작업을 다시 만들 필요가 없습니다.

### 이름 * {#chat}

```bash

/cron edit

--schedule "every 4h"

/cron edit --prompt "Use the revised task"

/cron edit --skill blogwatcher --skill maps

/cron edit --remove-skill blogwatcher

/cron edit --clear-skills

```

### 독립 CLI {#standalone-cli}

```bash

hermes cron edit --schedule "every 4h"

hermes cron edit --prompt "Use the revised task"

hermes cron edit --skill blogwatcher --skill maps

hermes cron edit --add-skill maps

hermes cron edit --remove-skill blogwatcher

hermes cron edit --clear-skills

```

참고:

- 반복 `--skill` 작업의 첨부된 기술 목록을 대체

- `--add-skill` 대체하지 않고 기존 목록에 추가

- `--remove-skill`는 특정 첨부 기술을 제거합니다

- `--clear-skills` 모든 첨부된 기술을 제거합니다

## Lifecycle 활동 {#lifecycle-actions}

Cron 작업은 이제 단지 생성 / 복구보다 전체 수명주기가 있습니다.

### 이름 * {#chat-1}

```bash

/cron list

/cron pause

/cron resume

/cron run

/cron remove

```

### 독립 CLI {#standalone-cli-1}

```bash

hermes cron list

hermes cron pause

hermes cron resume

hermes cron run

hermes cron remove

hermes cron status

hermes cron tick

```

그들은 무엇을:

- `pause` - 작업을 유지하지만 일정을 중지

- `resume` — 작업을 재 활성화하고 다음의 미래 실행을 계산

- `run` - 다음 스케줄러 진드기에 작업을 트리거

- `remove` - 완전히 삭제

## 어떻게 작동하나요 {#how-it-works}

**Cron 실행은 게이트웨이 데몬에 의해 처리됩니다. ** 게이트웨이는 60초마다 스케줄러를 틱하고, 고립된 에이전트 세션에서 발생하는 작업들을 실행합니다.

```bash

hermes gateway install # Install as a user service

sudo hermes gateway install --system # Linux: boot-time system service for servers

hermes gateway # Or run in foreground

hermes cron list

hermes cron status

```

### Gateway 스케줄러 행동 {#gateway-scheduler-behavior}

각 진드기에:

1. `~/.hermes/cron/jobs.json`에서 작업로드

2. 현재 시간에 대한 `next_run_at` 확인

3. 신선한 `AIAgent` 세션을 시작합니다

4. 선택적으로 그 신선한 세션으로 하나 이상의 첨부된 기술을 주사합니다

5. 완료하기 위해 신속한 실행

6. 마지막 응답을 전달하십시오

7. 업데이트는 metadata 및 다음 예정 시간

`~/.hermes/cron/.tick.lock`의 파일 잠금은 동일한 작업 배치를 두 배로 실행하는 스케줄러 진드기를 방지합니다.

## 배송 옵션 {#delivery-options}

스케줄링 작업을 할 때 출력이 진행되는지를 지정합니다

| 옵션 정보 | 이름 * | 이름 * |

|--------|-------------|---------|

| `"origin"`에 대해서 | 직업이 만든 곳 | 메시징 플랫폼의 기본 |

| `"local"`에 대해서 | 로컬 파일에 저장 (`~/.hermes/cron/output/`) | CLI에 기본값 |

| `"telegram"`에 대해서 | Telegram 홈 채널 | 사용 `TELEGRAM_HOME_CHANNEL` |

| `"telegram:123456"`에 대해서 | ID로 특정 전보 채팅 | 연락처 |

| `"telegram:-100123:17585"`에 대해서 | 특정 Telegram 주제 | `chat_id:thread_id` 형식 |

| `"discord"`에 대해서 | Discord 홈 채널 | 사용 `DISCORD_HOME_CHANNEL` |

| `"discord:#engineering"`에 대해서 | 특정 Discord 채널 | 채널 이름 |

| `"slack"`에 대해서 | Slack 홈 채널 | |

| `"whatsapp"`에 대해서 | WhatsApp 홈 | |

| `"signal"`에 대해서 | 주요 특징 | |

| `"matrix"`에 대해서 | 매트 홈 룸 | |

| `"mattermost"`에 대해서 | Mattermost 홈 채널 | |

| `"email"`에 대해서 | 이름 * | |

| `"sms"`에 대해서 | Twilio를 통해 SMS | |

| `"homeassistant"`에 대해서 | 홈 보조 | |

| `"dingtalk"`에 대해서 | DingTalk 소개 | |

| `"feishu"`에 대해서 | Feishu / 라크 | |

| `"wecom"`에 대해서 | 사이트맵 | |

| `"weixin"`에 대해서 | 웨이신 (WeChat) | |

| `"bluebubbles"`에 대해서 | BlueBubbles (iMessage) (이 메시지) | |

| `"qqbot"`에 대해서 | QQ Bot (텐센트 QQ) | |

| `"all"`에 대해서 | 모든 연결된 홈 채널에서 팬 | 화재 시간에 해결 |

| `"telegram,discord"`에 대해서 | 채널의 특정 설정에 팬 | Comma 제출 목록 |

| `"origin,all"`에 대해서 | Origin**plus**에 전달 | 모든 토큰 |

에이전트의 최종 응답은 자동으로 전달됩니다. cron 프롬프트에서 `send_message`를 호출 할 필요가 없습니다.

### 루팅 의도 (`all`) {#routing-intent-all}

`all` 는 이름에 의해 전달하지 않고 구성 된 모든 메시징 채널에 하나의 cron 작업을 배송 할 수 있습니다. 그것은 ** 화재 시간에 해결 **, 그래서 당신은 전보를 유선하기 전에 생성 된 작업은 __HER_TOKEN_00001__를 설정 한 후 다음 진드기에 전보를 선택합니다.

Semantics: `all`는 구성된 홈 채널을 가진 모든 플랫폼에 확장합니다. Zero는 괜찮습니다; 단순히 배달 대상을 생산하고 배달 실패 업스트림으로 기록됩니다.

`all`는 명시된 대상으로 구성합니다. `origin,all`는 원래 채팅 *plus*로 전달되며, 다른 연결된 홈 채널은 `(platform, chat_id, thread_id)`에 의해 해독됩니다.

### 응답 래핑 {#response-wrapping}

기본적으로 전달된 cron 출력은 헤더와 footer로 감싸이므로 수신자는 예정된 작업에서 왔습니다

```

Cronjob Response: Morning feeds

-------------

Note: The agent cannot see this message, and therefore cannot respond to it.

```

래퍼없이 원료 출력을 전달하려면 `cron.wrap_response`를 `false`로 설정하십시오

```yaml

# ~/.hermes/config.yaml

cron:

wrap_response: false

```

### 공급 능력 {#silent-suppression}

에이전트의 최종 응답이 `[SILENT]`로 시작되면 배달이 완전히 억제됩니다. 출력은 여전히 감사를 위해 로컬로 저장됩니다 (`~/.hermes/cron/output/`에서), 그러나 메시지는 배달 목표에 보내지 않습니다.

이것은 뭔가 잘못 될 때보고해야한다 작업 모니터링에 유용합니다:

```text

Check if nginx is running. If everything is healthy, respond with only [SILENT].

Otherwise, report the issue.

```

실패 작업은 항상 `[SILENT]` 마커에 관계없이 배달합니다. 성공적인 실행은 침묵 할 수 있습니다.

## 스크립트 timeout {#script-timeout}

Pre-run 스크립트 (`script` 매개 변수를 통해 지정)에는 120 초의 기본 타임아웃이 있습니다. 스크립트가 더 이상 필요하다면 — 예를 들어, bot-like 타이밍 패턴을 방지하는 임의 지연이 포함될 수 있습니다

```yaml

# ~/.hermes/config.yaml

cron:

script_timeout_seconds: 300 # 5 minutes

```

또는 `HERMES_CRON_SCRIPT_TIMEOUT` 환경 변수를 설정합니다. 해결책 순서는: env var → 구성. yaml → 120s 과태.

## 시약 모드 (script-only job) {#no-agent-mode-script-only-jobs}

LLM 이유가 필요하지 않은 재발견 작업 - 클래식 워치 독, 디스크 / 메모리 알림, 심베트, CI 핑 - 만들기 시간에 `no_agent=True`을 전달합니다. 스케줄러는 일정에 스크립트를 실행하고 직접 stdout을 제공, 전적으로 에이전트를 건너:

```bash

hermes cron create "every 5m" \

--no-agent \

--script memory-watchdog.sh \

--deliver telegram \

--name "memory-watchdog"

```

정액:

- 스크립트 stdout (trimmed) → 메시지로 동사 배달.

- ** Empty stdout → 침묵하는 진드기 **, 납품 없음. 이것은 watchdog 패턴입니다: "만 뭔가 잘못 될 때 무언가를 말한다".

- Non-zero Exit 또는 timeout → 오류 경고가 전달되므로 깨진 watchdog은 조용히 실패 할 수 없습니다.

- `{"wakeAgent": false}` 마지막 선에서 → 침묵하는 진드기 (사메 게이트 LLM 작업 사용).

- 토큰 없음, 모델 없음, 공급자 낙하 없음 - 작업은 방해 층을 결코 만지지 않습니다.

`.sh` / `.bash` 파일은 `/bin/bash`에서 실행됩니다. 현재 파이썬 해석기 (`sys.executable`)의 다른 점. 스크립트는 `~/.hermes/scripts/` (이전 스크립트 게이트로 동일한 샌드박스 규칙)에 있어야 합니다.

### 에이전트는 당신을 위해 이러한 설정 {#the-agent-sets-these-up-for-you}

`cronjob` 도구의 스키마가 `no_agent`를 직접 헤르메스에 노출하므로 채팅에서 워치를 설명할 수 있으며, 에이전트 와이어를 합시다

```text

Ping me on Telegram if RAM is over 85%, every 5 minutes.

```

Hermes는 `~/.hermes/scripts/`를 통해 `write_file`에 체크 스크립트를 작성하고 다음 호출합니다

```python

cronjob(action="create", schedule="every 5m",

script="memory-watchdog.sh", no_agent=True,

deliver="telegram", name="memory-watchdog")

```

그것은 `no_agent=True` 자동으로 메시지 내용이 스크립트 (watchdogs, 임계값 alerts, heartbeats)에 의해 완전히 결정 될 때. 동일한 도구는 에이전트 일시 중지, 이력서, 편집 및 작업 제거 - 그래서 전체 수명주기는 CLI를 터치하지 않고 채팅 구동됩니다.

[Script-Only Cron Jobs guide](/docs/guides/cron-script-only)를 참조해 주세요.

## `context_from`로 작업 {#chaining-jobs-with-contextfrom}

Cron 작업은 이전 실행의 메모리 없이 격리된 세션에서 실행됩니다. 하지만 때로는 하나의 작업의 출력은 정확히 다음 작업이 필요한 것입니다. `context_from` 매개 변수 와이어는 자동으로 연결됩니다. 작업 B의 프롬프트는 작업 A의 가장 최근 출력이 실행 시간에 컨텍스트로 사전 처리됩니다.

```python

# Job 1: Collect raw data

cronjob(

action="create",

prompt="Fetch the top 10 AI/ML stories from Hacker News. Save them to ~/.hermes/data/briefs/raw.md in markdown format with title, URL, and score.",

schedule="0 7 * * *",

name="AI News Collector",

)

# Job 2: Triage — receives Job 1's output as context

# Get Job 1's ID from: cronjob(action="list")

cronjob(

action="create",

prompt="Read ~/.hermes/data/briefs/raw.md. Score each story 1–10 for engagement potential and novelty. Output the top 5 to ~/.hermes/data/briefs/ranked.md.",

schedule="30 7 * * *",

context_from="",

name="AI News Triage",

)

# Job 3: Ship — receives Job 2's output as context

cronjob(

action="create",

prompt="Read ~/.hermes/data/briefs/ranked.md. Write 3 tweet drafts (hook + body + hashtags). Deliver to telegram:7976161601.",

schedule="0 8 * * *",

context_from="",

name="AI News Brief",

)

```

**일부:**

- 작업 2 화재 때, Hermes는 `~/.hermes/cron/output/{job1_id}/*.md`에서 가장 최근의 출력을 읽습니다

- 그 출력은 작업 2의 프롬프트에 자동으로 prepended

- Job 2는 "읽는이 파일"을 hardcode 할 필요가 없습니다 - 그것은 context로 콘텐츠를받습니다

- 사슬은 어떤 길이일 수 있습니다: 일 1 → 일 2 → 일 3 →...

** 어떤 `context_from`는 다음과 같습니다.**

| 지원하다 | 이름 * |

|--------|---------|

| 단일 작업 ID (문자) | `context_from="a1b2c3d4"`에 대해서 |

| 다수 일 ID (표) | `context_from=["job_a", "job_b"]`에 대해서 |

산출은 목록으로 만들어진 순서에서 concatenated.

**사용할 때:**

- Multi-stage 파이프라인 (collect → filter → format → deliver)

- N의 작업이 단계에 따라 달라집니다 N-1의 출력

- Fan-out/fan-in 패턴 어느 일 집계 결과에서 여러 다른 사람

## 공급자 회복 {#provider-recovery}

Cron 작업은 구성 된 fallback 제공 업체 및 자격 풀 회전을 상속합니다. 기본 API 키가 rate-limited 또는 공급자가 오류를 반환하면 cron 에이전트는 할 수 있습니다

- **변경 제공자로 돌아 가기 **`fallback_providers` (또는 레거시 `fallback_model`)가 있는 경우 **

- **[credential Pool](/docs/user-guide/configuration#credential-pool-strategies)에서 다음의 자격**에 따라 동일한 공급자를 위한

이것은 높은 주파수 또는 피크 시간에 실행하는 cron 작업이 더 탄력적입니다 - 단일 속도 제한 키는 전체 실행을 실패하지 않습니다.

## 일정표 {#schedule-formats}

에이전트의 최종 응답은 자동으로 전달됩니다. ****는 동일한 목적지에 대한 cron prompt의 `send_message`를 포함해야 합니다. cron이 호출하는 경우 `send_message` 을 정확한 대상에 스케줄러가 이미 전달 될 것입니다. Hermes는 중복 전송을 건너 최종 응답에 사용자 인터페이스 콘텐츠를 넣어 모델을 알려줍니다. `send_message`만 추가 또는 다른 대상에 사용하세요.

### 관계되는 지연 (one-shot) {#relative-delays-one-shot}

```text

30m → Run once in 30 minutes

2h → Run once in 2 hours

1d → Run once in 1 day

```

### 인터벌(recurring) {#intervals-recurring}

```text

every 30m → Every 30 minutes

every 2h → Every 2 hours

every 1d → Every day

```

### Cron 표현 {#cron-expressions}

```text

0 9 * * * → Daily at 9:00 AM

0 9 * * 1-5 → Weekdays at 9:00 AM

0 */6 * * * → Every 6 hours

30 8 1 * * → First of every month at 8:30 AM

0 0 * * 0 → Every Sunday at midnight

```

### ISO 타임스탬프 {#iso-timestamps}

```text

2026-03-15T09:00:00 → One-time at March 15, 2026 9:00 AM

```

## 반복 동작 {#repeat-behavior}

| 일정 유형 | 기본 반복 | 채용 정보 |

|--------------|----------------|----------|

| 원샷 (`30m`, 타임스탬프) | 1 | 한 번 실행 |

| 간격 (`every 2h`) | 지원하다 | 제거 할 때까지 실행 |

| Cron 표현 | 지원하다 | 제거 할 때까지 실행 |

당신은 그것을 override 할 수 있습니다:

```python

cronjob(

action="create",

prompt="...",

schedule="every 2h",

repeat=5,

)

```

## 작업 관리 {#managing-jobs-programmatically}

Agent-facing API는 하나의 도구입니다:

```python

cronjob(action="create",...)

cronjob(action="list")

cronjob(action="update", job_id="...")

cronjob(action="pause", job_id="...")

cronjob(action="resume", job_id="...")

cronjob(action="run", job_id="...")

cronjob(action="remove", job_id="...")

``update`의 경우, `skills=`를 통과하여 모든 첨부 기술을 제거하십시오.

## cron 작업에 사용할 수 있는 도구 {#toolsets-available-to-cron-jobs}

Cron은 채팅 플랫폼이 첨부되지 않는 신선한 에이전트 세션에서 각 작업을 실행합니다. 기본적으로 cron 에이전트가 **`cron` 플랫폼에 `hermes tools`**를 구성하는 도구입니다. — CLI 기본값이 아닌 모두 태양 아래.

```bash

hermes tools

# → pick the "cron" platform in the curses UI

# → toggle toolsets on/off just like you would for Telegram/Discord/etc.

```

꽉 per-job 제어는 `enabled_toolsets` 필드를 통해 사용할 수 있습니다. `cronjob.create` (또는 `cronjob.update`):

```text

cronjob(action="create", name="weekly-news-summary",

schedule="every sunday 9am",

enabled_toolsets=["web", "file"], # just web + file, no terminal/browser/etc.

prompt="Summarize this week's AI news:...")

``enabled_toolsets`가 이기는 일에 설정될 때; 그렇지 않으면 `hermes tools` cron-platform config wins; 그렇지 않으면 Hermes는 내장 기본으로 돌아갑니다. 비용 제어에 대한이 문제: 운반 `moa`, `browser`, `delegation` 모든 작은 "fetch news" 작업은 모든 LLM 통화에서 도구 - schema 프롬프트.

### 완전히 대리인을 건너 뛰기: `wakeAgent`에 대해서 {#toolsets-available-to-cron-jobs}

cron 작업이 pre-check 스크립트를 첨부하면 (`script=`), 스크립트는 Hermes가 에이전트를 호출 할 때 실행 시간에 결정할 수 있습니다. 형태의 마지막 stdout 선을 Emit:

```text

{"wakeAgent": false}

````python

# pre-check script

import json, sys

latest = fetch_latest_issue_count()

prev = read_state("issue_count")

if latest == prev:

print(json.dumps({"wakeAgent": False})) # skip this tick

sys.exit(0)

write_state("issue_count", latest)

print(json.dumps({"wakeAgent": True, "context": {"new_issues": latest - prev}}))

``wakeAgent`가 omitted일 때, 기본값은 `true`입니다. (일반적으로 에이전트를 사용).

#### 조리법: 저렴한 사전 실행 게이트 {#skipping-the-agent-entirely-wakeagent}

`wakeAgent` 게이트는 예정된 작업이 모든 LLM 토큰을 소비해야하는지 결정하는 데 $ 0의 방법을 제공합니다. 3개의 본 덮개 최대 사용 케이스.

**File-change gate** - 마지막 성공적인 진드기 이후의 파일이 새로운 내용이 있을 때만 실행됩니다. 스케줄러는 각 작업의 `last_run_at`를 기록합니다. 파일의 매번 비교합니다.

```bash

#!/bin/bash

# ~/.hermes/scripts/feed-changed.sh

FEED="$HOME/data/feed.json"

STATE="$HOME/.hermes/scripts/.feed-changed.last"

test -f "$FEED" || { echo '{"wakeAgent": false}'; exit 0; }

mtime=$(stat -c %Y "$FEED")

last=$(cat "$STATE" 2>/dev/null || echo 0)

if [ "$mtime" -le "$last" ]; then

echo '{"wakeAgent": false}'

else

echo "$mtime" > "$STATE"

echo '{"wakeAgent": true}'

fi

````text

cronjob(action="create", name="process-feed",

schedule="every 30m",

script="feed-changed.sh",

prompt="A new ~/data/feed.json has landed. Summarize what changed.")

```

**External-flag gate** - 다른 프로세스가 읽음을 신호 할 때만 실행됩니다 (예: 배치 후크는 파일을 삭제, CI 작업은 주점의 값을 설정합니다).

```bash

#!/bin/bash

# ~/.hermes/scripts/flag-ready.sh

if test -f /tmp/new-data-ready; then

rm -f /tmp/new-data-ready

echo '{"wakeAgent": true}'

else

echo '{"wakeAgent": false}'

fi

````text

cronjob(action="create", name="nightly-analysis",

schedule="0 9 * * *",

script="flag-ready.sh",

prompt="Run the nightly analysis over today's batch.")

```

** SQL-count gate** - 자신의 데이터베이스에서 처리 할 수있는 새로운 행이있을 때만 실행됩니다. 스크립트는 `context`를 통해 에이전트를 통해 계산을 통과 할 수 있으므로 에이전트는 다시 채우지 않고 찾는 방법을 알고 있습니다.

```python

#!/usr/bin/env python

# ~/.hermes/scripts/new-rows.py

import json, sqlite3

conn = sqlite3.connect("/home/me/data/app.db")

n = conn.execute(

"SELECT COUNT(*) FROM messages WHERE ts > strftime('%s','now','-2 hours')"

).fetchone()[0]

if n < 1:

print(json.dumps({"wakeAgent": False}))

else:

print(json.dumps({"wakeAgent": True, "context": {"new_rows": n}}))

````text

cronjob(action="create", name="summarize-new-msgs",

schedule="every 2h",

script="new-rows.py",

prompt="Summarize the new messages from the last 2 hours.")

```

같은 패턴은 스크립트에서 쿼리 할 수있는 모든 데이터 소스에 대한 작동 - Postgres, HTTP API, 당신의 자신의 상태 저장소 - SQL evaluator를 cron subsystem로 굽기없이.

:::tip

Hermes's own `~/.hermes/state.db`는 릴리스 사이에 변경되는 내부 스키마입니다. 사전 실행 게이트에서 쿼리하지 마십시오 - 자신의 데이터베이스에 포인트 또는 대신 피드.

:::

신용:이 레시피 세트는 @iankar8의 탐험에 의해 초안되었습니다 [#2654] (https://github.com/NousResearch/hermes-agent/pull/2654), 이는 평행 메커니즘으로 sql/file/command 트리거를 추가 제안. `script` + `wakeAgent` 게이트는 이미 $ 0의 모든 3 개의 케이스를 커버하므로 대신 문서로 착륙했습니다.

### 업무: `context_from`에 대해서 {#skipping-the-agent-entirely-wakeagent}

cron 작업은 `context_from`의 이름 (또는 ID)을 나열하여 하나의 다른 작업의 가장 최근 성공적인 출력을 소비 할 수 있습니다

```text

cronjob(action="create", name="daily-digest",

schedule="every day 7am",

context_from=["ai-news-fetch", "github-prs-fetch"],

prompt="Write the daily digest using the outputs above.")

```

참고된 작업의 가장 최근 완료된 출력은 이 실행의 상황에 따라 프롬프트 위에 주입됩니다. 각 상류 입력은 유효한 직업 ID 또는 이름이어야 합니다 (`cronjob action="list"`를 보십시오). 참고: chaining은 *most 최근 완료 * 출력을 읽습니다. 동일한 진드기에 실행되는 업스트림 작업을 기다릴 수 없습니다.

## 작업 저장 {#recipes-cheap-pre-run-gates}

작업은 `~/.hermes/cron/jobs.json`에 저장됩니다. 작업에서 출력은 `~/.hermes/cron/output/{job_id}/{timestamp}.md`에 저장됩니다.

작업은 저장할 수 있습니다 `model` 과 `provider` 로 `null`. 그 필드가 omitted 때, Hermes는 글로벌 구성에서 실행시에 해결합니다. 그들은 per-job override가 설정될 때 작업 레코드에 만 나타납니다.

저장 사용 원자 파일 쓰기 그래서 중단 된 쓰기는 부분적으로 작성된 작업 파일을 남겨두지 않습니다.

## 자기 유지 프롬프트는 여전히 중요 {#chaining-jobs-contextfrom}

:::warning Important {#chaining-jobs-contextfrom}

Cron 작업은 완전히 신선한 에이전트 세션에서 실행됩니다. 모든 에이전트가 첨부 된 기술에 의해 이미 제공되지 않은 필요는 포함해야합니다.

:::

**BAD:** `"Check on that server issue"`

**GOOD:** `"SSH into server 192.168.1.100 as user 'deploy', check if nginx is running with 'systemctl status nginx', and verify https://example.com returns HTTP 200."`

## 보안 보안 {#job-storage}

계획된 작업 프롬프트는 생성 및 업데이트 시간에 신속한 주입 및 credential-exfiltration 패턴을 위해 스캔됩니다. 보이지 않는 Unicode 트릭, SSH backdoor 시도, 또는 명백한 secret-exfiltration payloads를 포함하는 Prompts는 막습니다.

# 회사 소개

---

sidebar_position: 3

title: "회사 소개"

description: "에이전트 생성 기술에 대한 배경 유지 - 사용 추적, staleness, 아카이브, 및 LLM 구동 검토"

---

###### anchor alias {#pinning-a-skill}

# 회사 소개

커레이터는 ** 시약 생성 기술 **의 배경 유지 보수 패스입니다. 그것은 종종 각 기술이 보는 방법을 추적, 사용, 패치, `active → stale → archived` 주를 통해 긴 사용 기술을 이동, 정기적으로 결합 또는 헝겊 조각을 제안 짧은 보조 모델 검토.

[self-improvement loop](/docs/user-guide/features/skills#agent-managed-skills-skill_manage-tool)를 통해 생성된 기술이 존재합니다. 에이전트는 소설 문제를 해결하고 `~/.hermes/skills/`의 기술 토지를 저장합니다. 유지 보수없이 카탈로그 및 폐기물 토큰을 오염시키는 좁은 주변 장치 수십 개가 끝날 수 있습니다.

curator**never touch** 번들링 기술 (Repo로 배송) 또는 허브 설치 기술 ([agentskills.io](https://agentskills.io)). 그것은 단지 리뷰 기술 에이전트 자체 승인. 그것은 또한 ** 자동 삭제 ** - 최악의 결과 `~/.hermes/skills/.archive/`로 아카이브입니다, 복구 할 수 있습니다.

트랙 [issue #7816](https://github.com/NousResearch/hermes-agent/issues/7816).

## 어떻게 실행 {#how-it-runs}

커레이터는 현존성 검사에 의해 방아쇠가되지 않습니다. CLI 세션 시작, 그리고 게이트웨이의 cron-ticker 스레드 내부의 반복 진드기에, 헤르메스 검사 여부:

1. 마지막 커레이터 실행 이후 시간이 지나갔습니다 (`interval_hours`, default**7 days**)

2. 에이전트는 매우 긴 충분 (`min_idle_hours`, 기본 **2 시간**).

둘 다 사실이라면, `AIAgent`의 배경 포크를 떠난다. 메모리/스킬 자체 평가 판결에 의해 사용되는 동일한 패턴. 포크는 자체 프롬프트 캐시에서 실행되며 활성 대화를 결코 만지지 않습니다.

:::info First-run behavior

Brand-new install (또는 `hermes update`) 이후의 선구자 설치 시, 커레이터 ** 즉시 실행되지 않습니다 **. 첫 번째 관측 씨앗 `last_run_at`에서 "지금"으로 첫 번째 실제 패스를 하나 전체 `interval_hours`로 계산합니다. 이것은 기술 라이브러리를 검토 할 수있는 전체 간격을 제공합니다, 중요 한 핀, 또는 완전히 커레이터 전에 그것을 터치.

curator *would*가 실제 실행되기 전에 봅시다. `hermes curator run --dry-run`를 실행하면 라이브러리를 mutating하지 않고 동일한 검토 보고서를 생성합니다.

:::

실행에는 두 단계가 있습니다:

1. ** 자동 전환 ** (통역, LLM 없음). `stale_after_days` (30)는 `stale`; `archive_after_days`에 사용되지 않는 기술 (90)는 `~/.hermes/skills/.archive/`로 옮겨집니다.

2. **LLM 리뷰** (단일 보조 모델 패스, `max_iterations=8`). 위조된 대리인은 대리인 창조한 기술을 조사하고, `skill_view`를 가진 그들 모두를 읽을 수 있고, 헝겊 조각 (`skill_manage`를 통해), 끝 공구를 통해 overlapping 하나, 또는 아카이브를 통해서 결정합니다.

Pinned 기술은 커레이터의 자동 전환 및 에이전트의 자체 `skill_manage` 도구 모두에 제한됩니다. 아래에서 [기술](#pinning-a-skill)를 참조하십시오.

## 제품 설명 {#configuration}

모든 설정에서 라이브 `config.yaml` 아래 `curator:` (not `.env` - 이것은 비밀이 아닙니다). 기본 사항:

```yaml

curator:

enabled: true

interval_hours: 168 # 7 days

min_idle_hours: 2

stale_after_days: 30

archive_after_days: 90

```

완전히 비활성화하려면, `curator.enabled: false`를 설정합니다.

### 더 싼 보조 모델에 대한 리뷰를 실행 {#running-the-review-on-a-cheaper-aux-model}

커레이터의 LLM 검토 패스는 일반 보조 작업 슬롯입니다 - `auxiliary.curator` - Vision, Compression, Session Search 등 "Auto"는 "내 주요 채팅 모델을 사용"을 의미합니다. 대신 검토 패스에 대한 특정 공급자 + 모델을 핀으로 슬롯을 무시합니다.

** 가장 쉬운 - `hermes model`:**

```bash

hermes model # → "Auxiliary models — side-task routing"

# → pick "Curator" → pick provider → pick model

```

같은 피커는 **Models** 탭에서 웹 대시보드에서 사용할 수 있습니다.

**Direct config.yaml (동등):**

```yaml

auxiliary:

curator:

provider: openrouter

model: google/gemini-3-flash-preview

timeout: 600 # generous — reviews can take several minutes

```

Leaving `provider: auto` (기본값) 는 다른 모든 보조 작업의 행동과 일치하는 모든 주요 채팅 모델을 통해 검토 패스를 경로.

:::note Legacy config

Earlier 출시는 한 오프를 사용 `curator.auxiliary.{provider,model}` 블록. 이 경로는 여전히 작동하지만 퇴직 로그 라인을 방출 - 위의 `auxiliary.curator`에 마이그레이션하십시오. 따라서 커레이터는 동일한 배관 (`hermes model`, 대쉬보드 모델 탭, `base_url`, `api_key`, `timeout`, `...`)를 공유합니다.

:::

## 제품정보 {#cli}

```bash

hermes curator status # last run, counts, pinned list, LRU top 5

hermes curator run # trigger a review now (blocks until the LLM pass finishes)

hermes curator run --background # fire-and-forget: start the LLM pass in a background thread

hermes curator run --dry-run # preview only — report without any mutations

hermes curator backup # take a manual snapshot of ~/.hermes/skills/

hermes curator rollback # restore from the newest snapshot

hermes curator rollback --list # list available snapshots

hermes curator rollback --id # restore a specific snapshot

hermes curator rollback -y # skip the confirmation prompt

hermes curator pause # stop runs until resumed

hermes curator resume

hermes curator pin # never auto-transition this skill

hermes curator unpin

hermes curator restore # move an archived skill back to active

```

## 백업 및 롤백 {#backups-and-rollback}

모든 실제 커레이터 패스 전에, 헤르메스는 타를 걸립니다. `~/.hermes/skills/`의 gz 스냅샷 `~/.hermes/skills/.curator_backups/<utc-iso>/skills.tar.gz`. 패스 아카이브 또는 터치하지 않은 무언가를 통합하면 하나의 명령으로 전체 실행을 취소 할 수 있습니다

```bash

hermes curator rollback # restore newest snapshot (with confirmation)

hermes curator rollback -y # skip the prompt

hermes curator rollback --list # see all snapshots with reason + size

```

롤백 자체는 뒤집을 수 있습니다: 기술 트리를 교체하기 전에, 헤르메스는 `pre-rollback to <target-id>`를 태그하는 또 다른 스냅 샷이 걸립니다, 그래서 실수 롤백은 `--id`와 함께 그 하나 앞으로 회전 할 수 있습니다.

`hermes curator backup --reason "before-refactor"`로 언제든지 수동 스냅 샷을 취할 수 있습니다. `--reason` string lands in the snapshot's `manifest.json` 그리고 `--list`에 표시됩니다.

Snapshot은 `curator.backup.keep` (과태 5)로 실행되어 디스크 사용을 경계시킵니다

```yaml

curator:

backup:

enabled: true

keep: 5

``curator.backup.enabled: false`를 설정하여 자동 스냅 샷을 비활성화합니다. 수동 `hermes curator backup` 명령은 여전히 백업이 비활성화되었을 때 작동됩니다. `enabled: true`를 먼저 설정하면 플래그 게이트가 비대칭적으로 두 개의 경로가 두 개 있습니다. 실수로 mutating 실행에서 사전 실행 스냅 샷을 건너는 방법이 없습니다.

`hermes curator status`는 5가지 이상의 최소한의 사용 능력을 나열합니다. 즉, 다음의 stale이 될 가능성이 있는지 확인하는 빠른 방법.

동일한 서브콤마드는 실행 세션 (CLI 또는 게이트웨이 플랫폼) 내부의 `/curator` 슬래시 명령으로 사용할 수 있습니다.

## "agent-created"의 의미 {#what-agent-created-means}

그 이름은**not**인 경우 기술이 대리인으로 간주됩니다

- `~/.hermes/skills/.bundled_manifest` (설치에 재포에서 복사) 및

- `~/.hermes/skills/.hub/lock.json` (`hermes skills install`를 통해 설치되는 스킬).

`~/.hermes/skills/`의 다른 모든 것은 커레이터의 공정한 게임입니다. 다음을 포함합니다:

- 대화 중 `skill_manage(action="create")`를 통해 저장되는 에이전트를 기술합니다.

- 손으로 작성한 스킬 `SKILL.md`.

- Skills add via 외부 기술 디렉터리 you've pointed Hermes at.

:::warning Your hand-written skills look the same as agent-saved ones

Provenance 여기 ** (bundled/hub 대. 다른 모든 것). 커레이터는 개인 워크플로우에 의존할 수 없는 손전등 기술을 말할 수 없습니다. "agent-created" 버킷의 땅 모두.

첫번째 진짜 통행의 앞에 (과태에 의하여 임명 후에 7 일)는, 순간을 가지고 갑니다:

1. `hermes curator run --dry-run`를 실행하여 커레이터가 propose를 정확히 볼 수 있습니다.

2. `hermes curator pin <name>`를 사용하여 터치하지 않아도됩니다.

3. 또는 `curator.enabled: false`를 `config.yaml`로 설정하면 라이브러리를 직접 관리할 수 있습니다.

기록 보관소는 항상 `hermes curator restore <name>`를 통해 회복 가능하지만, 사실 후에 통합을 추적하는 것보다 더 쉽습니다.

:::

만약 당신이 터치 된 것에서 특정 기술을 보호하려는 경우 — 예를 들어 손을 잡은 기술에 의존 — 사용 `hermes curator pin <name>`. 다음 섹션을 참조하십시오.

## 기술 Pinning {#pinning-a-skill}

Pinning는 deletion의 기술을 보호합니다. 커레이터의 자동화된 아카이브 패스와 에이전트의 `skill_manage(action="delete")` 도구 호출. 기술이 핀이되면:

- **curator**는 자동 전환 중 (`active → stale → archived`)를 건너 뛰고 LLM 검토 패스는 혼자 떠나기 위해 지시됩니다.

- ** 시약 `skill_manage` 도구 **는 `delete`를 거부하여 `hermes curator unpin <name>`에서 사용자를 포팅합니다. 패치와 편집은 여전히 갑니다, 그래서 에이전트는 핀 / 핀 / 핀 댄스없이 파열로 핀 기술의 콘텐츠를 향상시킬 수 있습니다.

핀과 핀:

```bash

hermes curator pin <skill>

hermes curator unpin <skill>

```

flag는 `"pinned": true`로 저장됩니다.

** 시약 생성** 기술은 핀으로 묶을 수 있습니다. - 번들 및 허브 설치 기술은 첫 번째 장소에서 커레이터 멘토에 적용되지 않으며, `hermes curator pin`는 당신이 시도한 경우 폭발적인 메시지를 거부합니다.

"no deletion"보다 더 강한 보증을 원한다면 - 예를 들어, 에이전트가 여전히 그것을 읽는 동안 기술의 콘텐츠를 완전히 동결 - 편집기와 `~/.hermes/skills/<name>/SKILL.md` 편집. 핀 가드 도구 구동 deletion, 자신의 파일 시스템 액세스하지.

## 사용법 telemetry {#usage-telemetry}

커레이터는 `~/.hermes/skills/.usage.json`에서 스킬당 한 항목으로 사이드카를 유지합니다

```json

{

"my-skill": {

"use_count": 12,

"view_count": 34,

"last_used_at": "2026-04-24T18:12:",

"last_viewed_at": "2026-04-23T09:44:",

"patch_count": 3,

"last_patched_at": "2026-04-20T22:01:",

"created_at": "2026-03-01T14:20:",

"state": "active",

"pinned": false,

"archived_at": null

}

}

```

카운터 증가:

- `view_count`: 에이전트 호출 `skill_view` 기술에.

- `use_count`: 기술은 대화의 프롬프트로 로드됩니다.

- `patch_count`: `skill_manage patch/edit/write_file/remove_file`는 기술에 달려 있습니다.

번들 및 허브 설치 기술은 telemetry 쓰기에서 명시적으로 제외됩니다.

## Per-run 보고서 {#per-run-reports}

모든 커레이터가 `~/.hermes/logs/curator/` 아래의 타임스탬프 디렉토리를 작성합니다

```

~/.hermes/logs/curator/

└── 20260429-111512/

├── run.json # machine-readable: full fidelity, stats, LLM output

└── REPORT.md # human-readable summary

``REPORT.md`는 주어진 실행이 무엇인지 볼 수있는 빠른 방법입니다. 즉, LLM 검토자가 말한 LLM 검토자가 말한 것입니다. grep `agent.log` 없이 감사를 위해 좋은.

## 아카이브 기술 복원 {#what-agent-created-means}

커레이터가 여전히 원하는 무언가를 아카이브 한 경우:

```bash

hermes curator restore

```

이것은 `~/.hermes/skills/.archive/`에서 활성 트리에 다시 기술을 이동하고 `active`에 상태를 재설정합니다. 복원은 번들 또는 허브 설치 기술이 같은 이름으로 설치 된 경우를 거부합니다 (Would shadow upstream).

## 환경 당 해제 {#pinning-a-skill}

커레이터는 기본적으로 있습니다. 그것을 끄는:

- **하나의 프로파일 만:** 편집 `~/.hermes/config.yaml` (또는 활성 프로파일의 구성) 및 설정 `curator.enabled: false`.

- **일부 실행:** `hermes curator pause` — 세션 전반에 걸쳐 일시 중단; `resume`를 사용하여 재 활성화합니다.

curator는 `min_idle_hours`가 멈춰지지 않는 경우에도 동작하는 dev 기계에서 자연스럽게 스트레칭 중에만 실행됩니다.

## 더 보기 {#usage-telemetry}

- [Skills System](/docs/user-guide/features/skills) - 일반 및 자기 개선 루프에서 기술 작업하는 방법

- [Memory](/docs/user-guide/features/memory) - 장기 기억을 유지하는 평행한 배경 검토

- [Bundled Skills Catalog](/docs/reference/skills-catalog)에 대해 자세히 알아보기

- [Issue #7816](https://github.com/NousResearch/hermes-agent/issues/7816) - 원본 제안 및 디자인 토론

# 서브 시약 위임

---

sidebar_position: 7

title: "서브 시약 위임"

description: "delegate_task와 평행한 workstreams를 위한 Spawn에 의하여 고립되는 아이 대리인"

---

###### anchor alias {#depth-limit-and-nested-orchestration}

# 서브 시약 위임

`delegate_task` 도구는 격리된 컨텍스트, 제한 도구 및 자체 터미널 세션을 가진 아이 AIAgent 인스턴스를 낳습니다. 각 아이는 신선한 대화를 얻고 독립적으로 작동합니다. - 최종 요약 만 부모의 맥락을 입력합니다.

## 단일 작업 {#single-task}

```python

delegate_task(

goal="Debug why tests fail",

context="Error: assertion in test_foo.py line 42",

toolsets=["terminal", "file"]

)

```

## 평행한 배치 {#parallel-batch}

기본적으로 3개의 동시 subagents까지 (configurable, 단단한 천장 없음):

```python

delegate_task(tasks=[

{"goal": "Research topic A", "toolsets": ["web"]},

{"goal": "Research topic B", "toolsets": ["web"]},

{"goal": "Fix the build", "toolsets": ["terminal", "file"]}

])

```

## Subagent 컨텍스트 작동 방법 {#how-subagent-context-works}

:::warning Critical: Subagents Know Nothing {#how-subagent-context-works}

Subagents는 ** 완전 신선한 대화 **로 시작합니다. 그들은 부모의 대화 역사, 사전 도구 통화, 또는 위임 전에 논의 된 것들의 0 지식이 있습니다. 하위 시약의 유일한 컨텍스트는 `goal` 및 `context` 필드에서 모회사가 `delegate_task`를 호출할 때 나타납니다.

:::

이것은 부모 에이전트가 **everything** 호출의 하위 시약 요구 사항을 통과해야합니다.

```python

# BAD - subagent has no idea what "the error" is

delegate_task(goal="Fix the error")

# GOOD - subagent has all context it needs

delegate_task(

goal="Fix the TypeError in api/handlers.py",

context="""The file api/handlers.py has a TypeError on line 47:

'NoneType' object has no attribute 'get'.

The function process_request() receives a dict from parse_body(),

but parse_body() returns None when Content-Type is missing.

The project is at /home/user/myproject and uses Python 3.11."""

)

```

하위 시약은 목표와 컨텍스트에서 구축 된 집중된 시스템 프롬프트를 수신하고 작업을 완료하고 그것이 무엇인지의 구조화 된 요약을 제공, 그것이 발견 된 어떤 파일, 수정 된 모든 문제.

## Practical 예제 {#practical-examples}

### 병렬 연구 {#parallel-research}

동시에 여러 주제를 연구하고 요약을 수집:

```python

delegate_task(tasks=[

{

"goal": "Research the current state of WebAssembly in 2025",

"context": "Focus on: browser support, non-browser runtimes, language support",

"toolsets": ["web"]

},

{

"goal": "Research the current state of RISC-V adoption in 2025",

"context": "Focus on: server chips, embedded systems, software ecosystem",

"toolsets": ["web"]

},

{

"goal": "Research quantum computing progress in 2025",

"context": "Focus on: error correction breakthroughs, practical applications, key players",

"toolsets": ["web"]

}

])

```

### 코드 검토 + 수정 {#code-review--fix}

검토 및 수정 워크플로를 신선한 컨텍스트로 불러옵니다:

```python

delegate_task(

goal="Review the authentication module for security issues and fix any found",

context="""Project at /home/user/webapp.

Auth module files: src/auth/login.py, src/auth/jwt.py, src/auth/middleware.py.

The project uses Flask, PyJWT, and bcrypt.

Focus on: SQL injection, JWT validation, password handling, session management.

Fix any issues found and run the test suite (pytest tests/auth/).""",

toolsets=["terminal", "file"]

)

```

### 다중 파일 Refactoring {#multi-file-refactoring}

부모의 컨텍스트를 홍수시키는 큰 재발견 작업:

```python

delegate_task(

goal="Refactor all Python files in src/ to replace print() with proper logging",

context="""Project at /home/user/myproject.

Use the 'logging' module with logger = logging.getLogger(__name__).

Replace print() calls with appropriate log levels:

- print(f"Error:...") -> logger.error(...)

- print(f"Warning:...") -> logger.warning(...)

- print(f"Debug:...") -> logger.debug(...)

- Other prints -> logger.info(...)

Don't change print() in test files or CLI output.

Run pytest after to verify nothing broke.""",

toolsets=["terminal", "file"]

)

```

## 일괄 모드 세부 사항 {#batch-mode-details}

`tasks` 배열을 제공 할 때 스레드 풀을 사용하여 **parallel**에서 하위 시약 실행:

- **최대 통화:** 기본적으로 3개의 작업 (`delegation.max_concurrent_children` 또는 `DELEGATION_MAX_CONCURRENT_CHILDREN` env var를 통해 구성 가능; 1 층, 단단한 천장 없음). 제한보다 큰 배치는 침묵적으로 truncated보다 도구 오류를 반환합니다.

- ** 스레드 풀: ** `ThreadPoolExecutor`를 사용하여 구성된 통화 제한을 최대 노동자로 사용합니다

- ** 표시:** CLI 모드에서, 트리뷰는 per-task 완료 라인과 실시간 각 하위 시약에서 도구 통화를 보여줍니다. 게이트웨이 모드에서 진행은 부모의 진행 콜백에 배치되고 릴레이됩니다

- ** 결과 주문: ** 결과는 완료 순서에 관계없이 입력 순서를 일치하기 위하여 작업 색인에 의해 분류됩니다

- **분쟁:** 부모(예를 들어, 새 메시지를 보내)를 방해하는 모든 활성 어린이

Single-task delegation는 실 수영장 오버 헤드 없이 직접 실행됩니다.

## 모형 Override {#model-override}

`config.yaml`를 통해 하위 시약에 대한 다른 모델을 구성할 수 있습니다. 간단한 작업을 더 저렴하고 빠르게 모델에 위임하는 데 유용합니다

```yaml

# In ~/.hermes/config.yaml

delegation:

model: "google/gemini-flash-2.0" # Cheaper model for subagents

provider: "openrouter" # Optional: route subagents to a different provider

```

omitted 경우, subagents는 부모와 동일한 모델을 사용합니다.

## Toolset 선택 팁 {#toolset-selection-tips}

`toolsets` 매개 변수는 하위 시약이 접근하는 것을 제어합니다. 작업을 기반으로 선택하십시오

| Toolset 패턴 | 사용 사례 |

|----------------|----------|

| `["terminal", "file"]`에 대해서 | Code work, debugging, 파일 편집, 빌드 |

| `["web"]`에 대해서 | 연구, 사실 검사, 문서 보기 |

| `["terminal", "file", "web"]`에 대해서 | Full-stack 작업 (과태) |

| `["file"]`에 대해서 | 읽기 전용 분석, 실행하지 않고 코드 검토 |

| `["terminal"]`에 대해서 | 시스템 관리, 공정 관리 |

특정 도구는 지정한 내용에 관계없이 하위 시약에 대해 차단됩니다

- `delegation` - 잎 시약에 대한 차단 (기본값). `role="orchestrator"` 아이들은 `max_spawn_depth`에 의해 묶여 [Depth Limit and Nested Orchestration](#depth-limit-and-nested-orchestration)를 아래에서 볼 수 있습니다.

- `clarify` - 시약은 사용자와 상호 작용할 수 없습니다

- `memory` - 영구 기억을 공유하는 쓰기

- `code_execution` - 아이들은 단계별

- `send_message` - 크로스 플랫폼 부작용 없음 (예: Telegram 메시지 보내기)

## 최대 Iterations {#max-iterations}

각 시약에는 이탈 한계가 있습니다 (과태: 50) 많은 공구 외침이 그것을 가지고 가는 방법을 통제하는:

```python

delegate_task(

goal="Quick file check",

context="Check if /etc/nginx/nginx.conf exists and print its first 10 lines",

max_iterations=10 # Simple task, don't need many turns

)

```

## 아이 타임아웃 {#child-timeout}

시약은 `delegation.child_timeout_seconds` 벽시 초 이상에 조용히 갈 경우 갇혀있다. 기본값은 **600** (10 분) - 비 트리 바이알 연구 작업에 고밀도 모델 때문에 이전 릴리스에서 300 s에서 범퍼. Tune 그것 per-install:

```yaml

delegation:

child_timeout_seconds: 600 # default

```

빠른 국부적으로 모형을 위해 그것을 낮추십시오; 단단한 문제에 느린 reasoning 모형을 위해 그것을 올리십시오. 타이머는 아이가 API 호출 또는 도구 호출을 만들 때마다 재설정합니다. 정품 idle 노동자는 죽을 것입니다.

:::tip Diagnostic dump on zero-call timeout

** zero** API 호출 (보통: 공급자의 부정적, auth 실패, 또는 도구 - schema 거부)를 한 후 `delegate_task`는 `~/.hermes/logs/subagent-timeout-<session>-<timestamp>.log`에 구조화된 진단을 씁니다. 이전의 침묵 운동 행동보다 훨씬 쉽게.

:::

## 모니터링 실행 시약 (`/agents`) {#monitoring-running-subagents-agents}

TUI는 `/agents` 오버레이 (alias `/tasks`)를 재발견하는 `delegate_task` 팬 아웃을 일류 감사 표면으로 발송합니다

- 런닝의 라이브 트리보기 및 최근 완성 된 시약, 부모 그룹

- Per-branch 비용, 토큰 및 파일 터치 롤업

- Kill and pause controls — siblings를 중단하지 않고 특정 시약 중간 기쁨을 취소

- Post-hoc 검토: 각 하위 시약의 회전에 의한 역사를 통해 단계는 부모에 반환 한 후

고전적인 CLI는 텍스트 요약으로 `/agents`를 인쇄합니다. TUI는 오버레이 빛이 어디에 있습니다. [TUI - 슬래시 명령](/docs/user-guide/tui#slash-commands)를 참조하십시오.

## 깊이 한계와 둥지가 되는 Orchestration {#depth-limit-and-nested-orchestration}

기본적으로, 위임은 **flat**: 부모 (깊은 0) 스파드 어린이 (깊은 1), 그리고 그 아이들은 더 delegate 할 수 없습니다. 이 런웨이 recursive 위임을 방지합니다.

다단계 워크플로우(research → 종합, 또는 하위 프로블럼에 평행한 오케스트라션)의 경우, 부모는 spawn**orchestrator** 아이들이 자신의 노동자를 delegate 할 수 있습니다

```python

delegate_task(

goal="Survey three code review approaches and recommend one",

role="orchestrator", # Allows this child to spawn its own workers

context="...",

)

```

- `role="leaf"` (과태): 아이는 평평한 위임 행동과 동일하지 않습니다.

- `role="orchestrator"`: 아이는 `delegation` 툴릿을 유지합니다. `delegation.max_spawn_depth` (기본 **1** = 평평한, 그래서 `role="orchestrator"`는 기본값에서 노점입니다). `max_spawn_depth` 를 2로 올리며 관현관 아이들이 종족 잎을 웅장하게 할 수 있도록 합니다. 3단계(캡).

- `delegation.orchestrator_enabled: false`: `leaf`에 대한 모든 아이를 강제하는 글로벌 킬 스위치.

** 경고:** `max_spawn_depth: 3`와 `max_concurrent_children: 3`로 나무는 3×3×3 = 27 동시 잎 에이전트에 도달 할 수 있습니다. 각 추가 레벨 다변화 지출 — 상승 `max_spawn_depth` 의도적으로.

## 일생과 내구성 {#lifetime-and-durability}

:::warning delegate_task is synchronous — not durable {#lifetime-and-durability}

`delegate_task` 은 ** 부모의 현재 턴 ** 옆에 있습니다. 모든 아이가 끝날 때까지 부모를 차단합니다 (또는 취소됩니다). 그것은 ** 아니다 ** 배경 작업 큐:

- 부모가 중단되면 (사용자는 새로운 메시지를 보내, `/stop`, `/new`), 모든 활성 어린이가 취소하고 반환 `status="interrupted"`. 그들의 in-progress 일은 discarded.

- 아이들은 ** 부모가 종료 후 계속 실행되지 않습니다.

- 취소 된 아이들은 구조화 된 결과를 반환 (`status="interrupted"`, `exit_reason="interrupted"`), 그러나 부모가 너무 중단했기 때문에, 그 결과 종종 사용자 접근 가능한 대답으로 만들 수 없습니다.

**durable long-running work**는 중단하거나 현재 턴을 능숙해야 합니다

- `cronjob` (action=`create`) - 별도의 에이전트 실행을 계획합니다. 면역은 부모의 회전 중단을 방해합니다.

- `terminal(background=True, notify_on_complete=True)` - 에이전트가 다른 일을 수행하는 동안 실행되는 긴 실행 쉘 명령.

:::

## 키 속성 {#key-properties}

- 각 시약은 ** 단말 세션 ** (모자에서 계산)

- **Nested delegation is opt-in** — only `role="orchestrator"` children can delegate more, and only when __HMES_TOKEN_00001__는 1 (flat)의 기본으로 제기됩니다. `orchestrator_enabled: false`로 전 세계적으로 사용 가능.

- 잎 시약 ** 전화: `delegate_task`, `clarify`, `memory`, `send_message`, `execute_code`. Orchestrator subagents 유지 `delegate_task` 하지만 여전히 다른 4를 사용할 수 없습니다.

- **Interrupt propagation** - 부모는 모든 활성 어린이를 중단 (오케스트라의 할머니 포함)

- 최종 요약은 부모의 컨텍스트를 입력하고, 토큰 사용량을 효율적으로 유지

- Subagents는 부모의 **API 키, 공급자 구성 및 자격 풀 ** (요금 제한에 열쇠 교체를 활성화)

## 위임 vs run_code {#delegation-vs-executecode}

| 제품 설명 | 웹 사이트 | 실행_code |

|--------|--------------|-------------|

| **공개* * 이름 | 가득 차있는 LLM reasoning 반복 | Python 코드 실행 |

| **콘텍스** | 신선한 고립된 대화 | 대화 없음, 단지 스크립트 |

| **도구 액세스 ** | 모든 non-blocked 도구와 reasoning | RPC를 통해 7개의 공구, 이유 없음 |

| **주의 사항* * 이름 | 3 concurrent subagents by default (설정 가능) | 단일 스크립트 |

| **베스트 ** | 복잡한 작업 필요 판단 | 기계적인 다단계 파이프라인 |

| **토큰 비용** | 높은 (풀 LLM 루프) | 낮은 (만 stdout 반환) |

| **사용자 상호작용 ** | 없음 (subagents는 명확하게 할 수 없습니다) | 이름 * |

**엄지:** `delegate_task`를 사용하여 하위 작업이 이유, 판단, 또는 다중 단계 문제 해결이 필요합니다. 사용 `execute_code` 당신은 기계 데이터 처리 또는 스크립트 작업 흐름을 필요로 할 때.

## 제품 설명 {#configuration}

```yaml

# In ~/.hermes/config.yaml

delegation:

max_iterations: 50 # Max turns per child (default: 50)

# max_concurrent_children: 3 # Parallel children per batch (default: 3)

# max_spawn_depth: 1 # Tree depth (1-3, default 1 = flat). Raise to 2 to allow orchestrator children to spawn leaves; 3 for three levels.

# orchestrator_enabled: true # Disable to force all children to leaf role.

model: "google/gemini-3-flash-preview" # Optional provider/model override

provider: "openrouter" # Optional built-in provider

# Or use a direct custom endpoint instead of provider:

delegation:

model: "qwen2.5-coder"

base_url: "http://localhost:1234/v1"

api_key: "local-key"

```

:::tip

에이전트는 작업 복잡성을 기반으로 위임을 자동으로 처리합니다. 명시적으로 delegate에 요청할 필요가 없습니다. 그렇게 할 것입니다.

:::

# 대시보드 확장

---

sidebar_position: 17

title: "대시보드 확장"

description: "Hermes 웹 대시보드를 위한 테마와 플러그인을 구축하세요 — 팔레트, 타이포그래피, 레이아웃, 커스텀 탭, 셸 슬롯, 페이지 스코프 슬롯, 백엔드 API 경로"

---

###### anchor alias {#api-reference}

###### anchor alias {#augmenting-built-in-pages-page-scoped-slots}

###### anchor alias {#backend-api-routes}

###### anchor alias {#built-in-themes}

###### anchor alias {#color-overrides}

###### anchor alias {#combined-theme--plugin-demo}

###### anchor alias {#component-chrome-overrides}

###### anchor alias {#custom-css-per-plugin}

###### anchor alias {#directory-layout}

###### anchor alias {#full-theme-yaml-reference}

###### anchor alias {#layout-variants}

###### anchor alias {#manifest-reference}

###### anchor alias {#palette-typography-layout}

###### anchor alias {#plugin-discovery--reload}

###### anchor alias {#plugins}

###### anchor alias {#quick-start--your-first-plugin}

###### anchor alias {#quick-start--your-first-theme}

###### anchor alias {#raw-customcss}

###### anchor alias {#replacing-built-in-pages-taboverride}

###### anchor alias {#shell-slots}

###### anchor alias {#slot-only-plugins-tabhidden}

###### anchor alias {#the-plugin-sdk}

###### anchor alias {#theme-assets-images-as-css-vars}

###### anchor alias {#themes}

###### anchor alias {#troubleshooting}

# 대시보드 확장

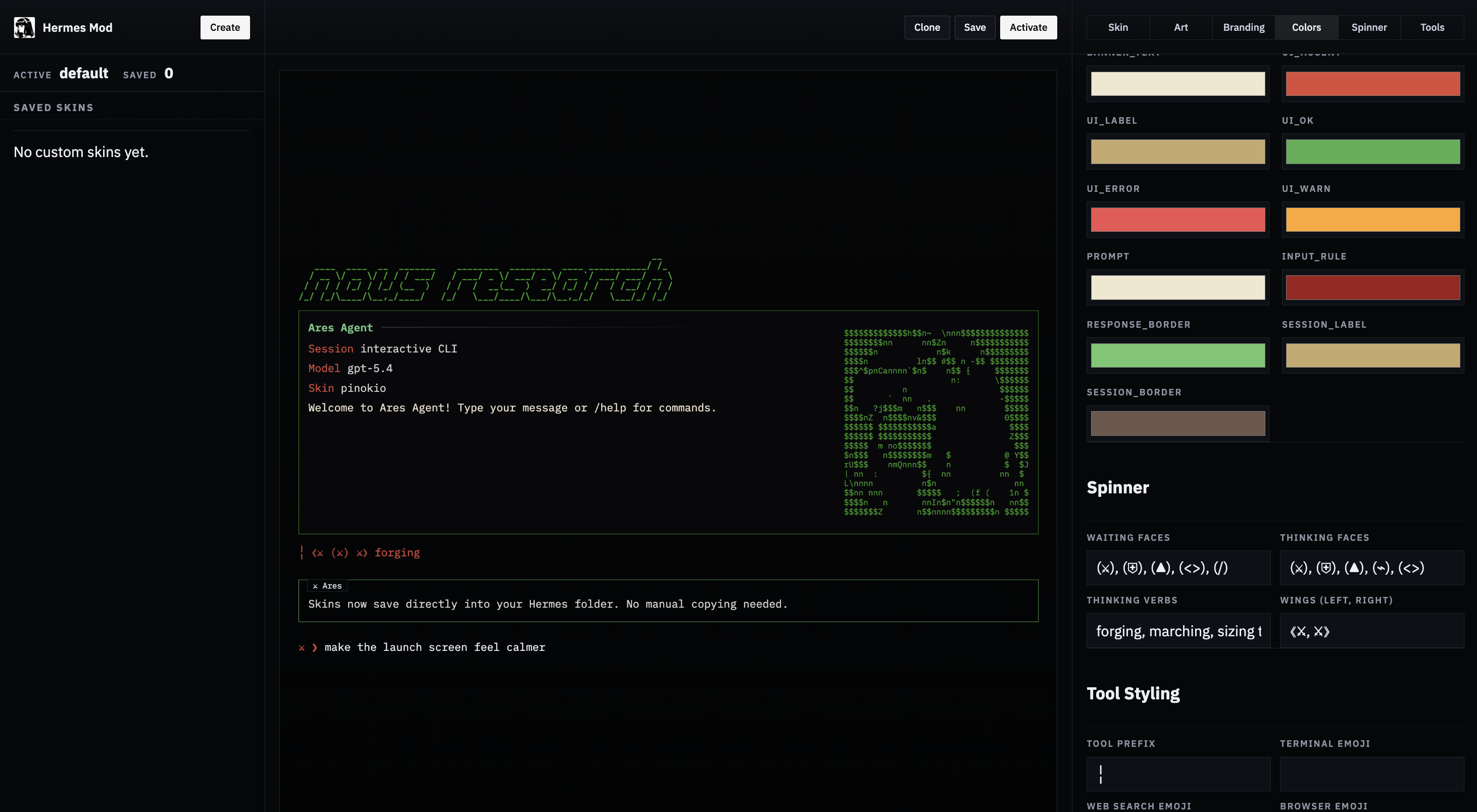

Hermes 웹 대시보드 (`hermes dashboard`)는 코드베이스를 포크하지 않고도 리스킨 및 확장이 가능하도록 설계되었습니다. 세 가지 계층이 노출됩니다:

1. **테마** — 대시보드의 팔레트, 타이포그래피, 레이아웃 및 구성 요소별 크롬을 재페인트하는 YAML 파일입니다. `~/.hermes/dashboard-themes/`에 파일을 넣으면 테마 스위처에 나타납니다.

2. **UI 플러그인** — 탭을 등록하거나, 내장 페이지를 교체하거나, 페이지 범위 슬롯을 통해 하나를 확장하거나, 명명된 셸 슬롯에 컴포넌트를 주입하는 `manifest.json` + 자바스크립트 번들이 포함된 디렉토리.

3. **백엔드 플러그인** — 플러그인 디렉토리 안에 있는 Python 파일로 FastAPI `router`를 노출합니다; 라우트는 `/api/plugins/<name>/` 아래에 마운트되며 플러그인의 UI에서 호출됩니다.

세 가지 모두 **런타임에 바로 적용**됩니다: 저장소를 복제할 필요도, `npm run build`도, 대시보드 소스를 패치할 필요도 없습니다. 이 페이지가 세 가지 모두에 대한 정식 참조입니다.

대시보드만 사용하고 싶다면 [웹 대시보드](./web-dashboard)를 참조하세요. 터미널 CLI(웹 대시보드가 아님)를 리스킨하려면 [스킨 & 테마](./skins)를 참조하세요 — CLI 스킨 시스템은 대시보드 테마와 관련이 없습니다.

:::note How the pieces compose

테마와 플러그인은 독립적이지만 시너지 효과를 냅니다. 테마는 단독으로 존재할 수 있습니다(YAML 파일 하나만으로). 플러그인도 단독으로 존재할 수 있습니다(탭 하나만으로). 함께 사용하면 커스텀 HUD가 포함된 완전한 비주얼 리스킨을 만들 수 있습니다 — 번들로 제공되는 `strike-freedom-cockpit` 데모가 바로 그 예입니다. [결합된 테마 + 플러그인 데모](#combined-theme--plugin-demo)를 참조하세요.

:::

---

## 목차 {#table-of-contents}

- [주제](#themes)

- [빠른 시작 — 당신의 첫 번째 테마](#quick-start--your-first-theme)

- [팔레트, 타이포그래피, 레이아웃](#palette-typography-layout)

- [레이아웃 변형](#layout-variants)

- [테마 자산 (CSS 변수로서의 이미지)](#theme-assets-images-as-css-vars)

- [컴포넌트 크롬 오버라이드](#component-chrome-overrides)

- [색상 덮어쓰기](#color-overrides)

- [원본 `customCSS`](#raw-customcss)

- [내장 테마](#built-in-themes)

- [전체 테마 YAML 참조](#full-theme-yaml-reference)

- [플러그인](#plugins)

- [빠른 시작 — 첫 번째 플러그인](#quick-start--your-first-plugin)

- [디렉토리 구조](#directory-layout)

- [매니페스트 참조](#manifest-reference)

- [플러그인 SDK](#the-plugin-sdk)

- [쉘 슬롯](#shell-slots)

- [내장 페이지 교체 (`tab.override`)](#replacing-built-in-pages-taboverride)

- [내장 페이지 확장하기(페이지 범위 슬롯)](#augmenting-built-in-pages-page-scoped-slots)

- [슬롯 전용 플러그인 (`tab.hidden`)](#slot-only-plugins-tabhidden)

- [백엔드 API 경로](#backend-api-routes)

- [플러그인별 사용자 정의 CSS](#custom-css-per-plugin)

- [플러그인 검색 및 다시 불러오기](#plugin-discovery--reload)

- [통합 테마 + 플러그인 데모](#combined-theme--plugin-demo)

- [API 참고](#api-reference)

- [문제 해결](#troubleshooting)

---

## 테마 {#themes}

테마는 `~/.hermes/dashboard-themes/`에 저장된 YAML 파일입니다. 파일 이름은 중요하지 않으며(시스템에서 사용하는 것은 테마의 `name:` 필드입니다), 일반적인 관례는 `<name>.yaml`입니다. 모든 필드는 선택 사항이며, 누락된 키는 내장 `default` 테마로 대체되므로 테마는 하나의 색상만 있어도 됩니다.

### 빠른 시작 — 첫 번째 테마 {#quick-start--your-first-theme}

```bash

mkdir -p ~/.hermes/dashboard-themes

````yaml

# ~/.hermes/dashboard-themes/neon.yaml

name: neon

label: Neon

description: Pure magenta on black

palette:

background: "#000000"

midground: "#ff00ff"

```

대시보드를 새로 고침하세요. 헤더의 팔레트 아이콘을 클릭하고 **Neon**을 선택하세요. 배경은 검은색으로 바뀌고, 텍스트와 강조 색상은 마젠타 색상이 되며, 모든 파생 색상(카드, 테두리, 무음, 링 등)은 CSS에서 `color-mix()`를 통해 그 두 가지 색상 트리플렛으로부터 다시 계산됩니다.

그게 전체 온보딩 과정입니다: 한 개의 파일, 두 가지 색상. 그 아래의 모든 것은 선택적인 개선입니다.

### 팔레트, 타이포그래피, 레이아웃 {#palette-typography-layout}

이 세 블록은 주제의 핵심입니다. 각각 독립적입니다 — 하나를 덮어쓰고 나머지는 그대로 두세요.

#### 팔레트 (3층) {#palette-3-layer}

팔레트는 세 개의 색상 레이어와 따뜻한 빛의 비네트 색상, 그리고 노이즈-그레인 배수로 구성된 삼중 구조입니다. 대시보드의 디자인 시스템 캐스케이드는 CSS `color-mix()`를 통해 이 삼중 구조에서 모든 shadcn 호환 토큰(카드, 팝오버, 뮤트, 경계선, 기본, 파괴, 링 등)을 도출합니다. 세 가지 색상을 재정의하면 전체 UI에 영향을 미칩니다.

| 열쇠 | 설명 |

|-----|-------------|

| `palette.background` | 가장 깊은 캔버스 색상 — 일반적으로 거의 검은색에 가까움. 페이지 배경과 카드 채우기를 구동함. |

| `palette.midground` | 주요 텍스트와 강조. 대부분의 UI 크롬은 이것을 읽습니다(전경 텍스트, 버튼 윤곽, 포커스 링). |

| `palette.foreground` | 최상단 강조. 기본 테마는 이것을 알파 0(보이지 않음)인 흰색으로 설정합니다. 상단에 밝은 강조를 원하는 테마는 알파 값을 높일 수 있습니다. |

| `palette.warmGlow` | `rgba(...)` 는 `<Backdrop />` 에 의해 비네트 색상으로 사용됩니다. |

| `palette.noiseOpacity` | 곡물 오버레이에 0–1.2 배수 적용. 낮게 설정 = 부드러움, 높게 설정 = 거침. |

각 레이어는 `{hex: "#RRGGBB", alpha: 0.0–1.0}` 또는 일반 16진수 문자열을 허용합니다(알파 값은 기본적으로 1.0입니다).

```yaml

palette:

background:

hex: "#05091a"

alpha: 1.0

midground: "#d8f0ff" # bare hex, alpha = 1.0

foreground:

hex: "#ffffff"

alpha: 0 # invisible top layer

warmGlow: "rgba(255, 199, 55, 0.24)"

noiseOpacity: 0.7

```

#### 타이포그래피 {#typography}

| 열쇠 | 타입 | 설명 |

|-----|------|-------------|

| `fontSans` | 문자열 | 본문 글자에 대한 CSS 글꼴 패밀리 스택 (`html`, `body`에 적용됨). |

| `fontMono` | 문자열 | 코드 블록용 CSS 글꼴 패밀리 스택, `<code>`, `.font-mono` 유틸리티. |

| `fontDisplay` | 문자열 | 선택적 헤딩/디스플레이 스택. `fontSans`로 대체됩니다. |

| `fontUrl` | 문자열 | 선택적 외부 스타일시트 URL. 테마 전환 시 `<head>`에 `<link rel="stylesheet">`으로 주입됩니다. 동일한 URL은 두 번 주입되지 않습니다. Google Fonts, Bunny Fonts, 자체 호스팅 `@font-face` 시트 등 링크 가능한 모든 것과 작동합니다. |

| `baseSize` | 문자열 | 루트 글꼴 크기 — rem 스케일을 제어합니다. 예: `"14px"`, `"16px"`. |

| `lineHeight` | 문자열 | 기본 줄간격. 예: `"1.5"`, `"1.65"`. |

| `letterSpacing` | 문자열 | 기본 글자 간격. 예: `"0"`, `"0.01em"`, `"-0.01em"`. |

```yaml

typography:

fontSans: '"Orbitron", "Eurostile", "Impact", sans-serif'

fontMono: '"Share Tech Mono", ui-monospace, monospace'

fontDisplay: '"Orbitron", "Eurostile", sans-serif'

fontUrl: "https://fonts.googleapis.com/css2?family=Orbitron:wght@400;500;600;700&family=Share+Tech+Mono&display=swap"

baseSize: "14px"

lineHeight: "1.5"

letterSpacing: "0.04em"

```

#### 레이아웃 {#layout}

| 열쇠 | 값 | 설명 |

|-----|--------|-------------|

| `radius` | 모든 CSS 길이 (`"0"`, `"0.25rem"`, `"0.5rem"`, `"1rem"`,...) | 모서리 반경 토큰. `--radius`에 매핑되며 `--radius-sm/md/lg/xl`로 이어집니다 — 모든 둥근 요소가 함께 이동합니다. |

| `density` | `compact` "| `comfortable` "| `spacious` | 간격 배수는 `--spacing-mul` CSS 변수로 적용됩니다. `compact = 0.85×`, `comfortable = 1.0×` (기본값), `spacious = 1.2×`. Tailwind의 기본 간격을 조정하므로, 패딩, 간격, space-between 유틸리티가 모두 비례하여 이동합니다. |

```yaml

layout:

radius: "0"

density: compact

```

### 레이아웃 변형 {#layout-variants}

`layoutVariant` 는 전체 쉘 레이아웃을 선택합니다. 없을 경우 기본값은 `"standard"` 입니다.

| 변형 | 행동 |

|---------|-----------|

| `standard` | 단일 열, 최대 너비 1600px (기본값). |

| `cockpit` | 왼쪽 사이드바 레일(260px) + 주요 콘텐츠. `sidebar` 슬롯을 통해 플러그인으로 채워짐 — [Shell 슬롯](#shell-slots) 참고. 플러그인이 없으면 레일에 자리 표시자가 표시됩니다. |

| `tiled` | 페이지가 전체 뷰포트 너비를 사용할 수 있도록 최대 너비 제한을 제거합니다. |

```yaml

layoutVariant: cockpit

```

현재 변형은 `document.documentElement.dataset.layoutVariant`로 노출되므로, `customCSS`의 원시 CSS가 `:root[data-layout-variant="cockpit"]...`를 통해 이를 타겟팅할 수 있습니다.

### 테마 자산 (CSS 변수로서의 이미지) {#theme-assets-images-as-css-vars}

테마가 있는 선박 아트워크 URL. 각 이름이 지정된 슬롯은 내장 셸과 모든 플러그인이 읽을 수 있는 CSS 변수(`--theme-asset-<name>`)가 됩니다. `bg` 슬롯은 자동으로 배경에 연결되며, 다른 슬롯은 플러그인 대상으로 사용됩니다.

```yaml

assets:

bg: "https://example.com/hero-bg.jpg" # auto-wired into <Backdrop />

hero: "/my-images/strike-freedom.png" # for plugin sidebars

crest: "/my-images/crest.svg" # for header-left plugins

logo: "/my-images/logo.png"

sidebar: "/my-images/rail.png"

header: "/my-images/header-art.png"

custom:

scanLines: "/my-images/scanlines.png" # → --theme-asset-custom-scanLines

```

값을 허용:

- 일반 URL — `url(...)`로 자동으로 감쌉니다.

- 사전 포장된 `url(...)`, `linear-gradient(...)`, `radial-gradient(...)` 표현 — 그대로 사용됩니다.

- `"none"` — 명시적 옵트아웃.

모든 자산은 또한 `--theme-asset-<name>-raw` (언랩된 URL)로도 내보내지며, 이는 플러그인이 `background-image` 대신 `![]() `으로 전달해야 할 경우를 대비한 것입니다.

플러그인은 일반 CSS나 JS로 이것들을 읽습니다:

```javascript

// In a plugin slot

const hero = getComputedStyle(document.documentElement).getPropertyValue("--theme-asset-hero").trim();

```

### 컴포넌트 크롬 오버라이드 {#component-chrome-overrides}

`componentStyles`는 CSS 선택자를 작성하지 않고 개별 셸 구성 요소의 스타일을 다시 지정합니다. 각 버킷의 항목은 셸의 공유 구성 요소가 읽는 CSS 변수(`--component-<bucket>-<kebab-property>`)가 됩니다. 따라서 `card:` 재정의는 모든 `<Card>`에 적용되며, `header:`는 앱 바에 적용됩니다.

```yaml

componentStyles:

card:

clipPath: "polygon(12px 0, 100% 0, 100% calc(100% - 12px), calc(100% - 12px) 100%, 0 100%, 0 12px)"

background: "linear-gradient(180deg, rgba(10, 22, 52, 0.85), rgba(5, 9, 26, 0.92))"

boxShadow: "inset 0 0 0 1px rgba(64, 200, 255, 0.28)"

header:

background: "linear-gradient(180deg, rgba(16, 32, 72, 0.95), rgba(5, 9, 26, 0.9))"

tab:

clipPath: "polygon(6px 0, 100% 0, calc(100% - 6px) 100%, 0 100%)"

sidebar: {}

backdrop: {}

footer: {}

progress: {}

badge: {}

page: {}

```

지원되는 버킷: `card`, `header`, `footer`, `sidebar`, `tab`, `progress`, `badge`, `backdrop`, `page`.

속성 이름은 camelCase(`clipPath`)를 사용하고 kebab(`clip-path`)로 출력됩니다. 값은 일반 CSS 문자열입니다 — CSS가 허용하는 모든 것(`clip-path`, `border-image`, `background`, `box-shadow`, `animation`,...).

### 색상 덮어쓰기 {#color-overrides}

대부분의 테마는 이것이 필요하지 않습니다 — 3계층 팔레트가 모든 shadcn 토큰을 도출합니다. 도출 과정에서 나오지 않는 특정 강조색이 필요할 때 `colorOverrides`을 사용하세요 (파스텔 테마를 위한 더 부드러운 파괴적 빨강, 브랜드를 위한 특정 성공 녹색 등).

```yaml

colorOverrides:

primary: "#ffce3a"

primaryForeground: "#05091a"

accent: "#3fd3ff"

ring: "#3fd3ff"

destructive: "#ff3a5e"

border: "rgba(64, 200, 255, 0.28)"

```

지원되는 키: `card`, `cardForeground`, `popover`, `popoverForeground`, `primary`, `primaryForeground`, `secondary`, `secondaryForeground`, `muted`, `mutedForeground`, `accent`, `accentForeground`, `destructive`, `destructiveForeground`, `success`, `warning`, `border`, `input`, `ring`.

각 키는 `--color-<kebab>` CSS 변수에 1:1로 매핑됩니다 (예: `primaryForeground` → `--color-primary-foreground`). 여기에서 설정된 모든 키는 활성 테마에 대해서만 팔레트 계층보다 우선합니다 — 다른 테마로 전환하면 재정의가 삭제됩니다.

### 원시 `customCSS` {#raw-customcss}

선택자 수준의 크롬으로 인해 `componentStyles`이(가) 표현할 수 없는 경우 — 의사 요소, 애니메이션, 미디어 쿼리, 테마 범위 재정의 — 원시 CSS를 `customCSS`에 넣으세요:

```yaml

customCSS: |

/* Scanline overlay — only visible when cockpit variant is active. */:root[data-layout-variant="cockpit"] body::before {

content: "";

position: fixed;

inset: 0;

pointer-events: none;

z-index: 100;

background: repeating-linear-gradient(to bottom,

transparent 0px, transparent 2px,

rgba(64, 200, 255, 0.035) 3px, rgba(64, 200, 255, 0.035) 4px);

mix-blend-mode: screen;

}

```

CSS는 테마 적용 시 단일 범위 `<style data-hermes-theme-css>` 태그로 주입되며 테마 전환 시 정리됩니다. **테마당 32 KiB로 제한됩니다.**

### 내장 테마 {#built-in-themes}

각 내장 항목은 자체 팔레트, 타이포그래피 및 레이아웃을 제공하며 — 전환하면 색상뿐만 아니라 다른 눈에 띄는 변화도 발생합니다.

| 주제 | 팔레트 | 타이포그래피 | 레이아웃 |

|-------|---------|------------|--------|

| **헤르메스 틸** (`default`) | 다크 티얼 + 크림 | 시스템 스택, 15픽셀 | 0.5rem 반경, 편안한 |

| **에르메스 틸 (대형)** (`default-large`) | 기본값과 동일 | 시스템 스택, 18px, 줄 높이 1.65 | 0.5rem 반경, 넓은 |

| **자정** (`midnight`) | 짙은 청자주 | 인터 + JetBrains 모노, 14px | 0.75rem 반경, 편안한 |

| **엠버** (`ember`) | 따뜻한 진홍색 + 청동 | Spectral (세리프) + IBM Plex Mono, 15px | 0.25rem 반경, 편안한 |

| **모노** (`mono`) | 그레이스케일 | IBM Plex Sans + IBM Plex Mono, 13픽셀 | 0 반경, 컴팩트 |

| **사이버펑크** (`cyberpunk`) | 검은색 위의 네온 그린 | Share Tech Mono 어디서나, 14px | 0 반경, 컴팩트 |

| **로제** (`rose`) | 핑크 + 아이보리 | Fraunces (세리프) + DM Mono, 16px | 1rem 반지름, 넓은 |

Google Fonts를 참조하는 테마( Hermes Teal 제외)는 필요에 따라 스타일시트를 로드합니다 — 처음으로 해당 테마로 전환할 때 `<link>` 태그가 `<head>`에 삽입됩니다.

### 전체 테마 YAML 참조 {#full-theme-yaml-reference}

모든 노브를 한 파일에 — 필요 없는 것은 복사하고 잘라내세요:

```yaml

# ~/.hermes/dashboard-themes/ocean.yaml

name: ocean

label: Ocean Deep

description: Deep sea blues with coral accents

# 3-layer palette (accepts {hex, alpha} or bare hex)

palette:

background:

hex: "#0a1628"

alpha: 1.0

midground:

hex: "#a8d0ff"

alpha: 1.0

foreground:

hex: "#ffffff"

alpha: 0.0

warmGlow: "rgba(255, 107, 107, 0.35)"

noiseOpacity: 0.7

typography:

fontSans: "Poppins, system-ui, sans-serif"

fontMono: "Fira Code, ui-monospace, monospace"

fontDisplay: "Poppins, system-ui, sans-serif" # optional

fontUrl: "https://fonts.googleapis.com/css2?family=Poppins:wght@400;500;600&family=Fira+Code:wght@400;500&display=swap"

baseSize: "15px"

lineHeight: "1.6"

letterSpacing: "-0.003em"

layout:

radius: "0.75rem"

density: comfortable

layoutVariant: standard # standard | cockpit | tiled

assets:

bg: "https://example.com/ocean-bg.jpg"

hero: "/my-images/kraken.png"

crest: "/my-images/anchor.svg"

logo: "/my-images/logo.png"

custom:

pattern: "/my-images/waves.svg"

componentStyles:

card:

boxShadow: "inset 0 0 0 1px rgba(168, 208, 255, 0.18)"

header:

background: "linear-gradient(180deg, rgba(10, 22, 40, 0.95), rgba(5, 9, 26, 0.9))"

colorOverrides:

destructive: "#ff6b6b"

ring: "#ff6b6b"

customCSS: |

/* Any additional selector-level tweaks */

```

파일을 만든 후 대시보드를 새로 고치세요. 헤더 바에서 실시간으로 테마를 전환하려면 팔레트 아이콘을 클릭하세요. 선택은 `config.yaml` 아래의 `dashboard.theme`에 유지되며 새로 고침 시 복원됩니다.

---

## 플러그인 {#plugins}

대시보드 플러그인은 `manifest.json`, 미리 빌드된 JS 번들, 선택적으로 CSS 파일과 FastAPI 경로가 포함된 Python 파일이 있는 디렉토리입니다. 플러그인은 `~/.hermes/plugins/<name>/`에 있는 다른 Hermes 플러그인 옆에 위치하며 — 대시보드 확장은 해당 플러그인 디렉토리 안의 `dashboard/` 하위 폴더이므로, 하나의 플러그인으로 단일 설치에서 CLI/게이트웨이와 대시보드 둘 다 확장할 수 있습니다.

플러그인은 React나 UI 컴포넌트를 번들로 포함하지 않습니다. 이들은 `window.`...``에 노출된 **Plugin SDK**를 사용합니다. 이는 플러그인 번들을 작게 유지하고(보통 몇 KB 정도) 버전 충돌을 방지합니다.

### 빠른 시작 — 첫 번째 플러그인 {#quick-start--your-first-plugin}

디렉토리 구조를 생성하세요:

```bash

mkdir -p ~/.hermes/plugins/my-plugin/dashboard/dist

```

매니페스트를 작성하세요:

```json

// ~/.hermes/plugins/my-plugin/dashboard/manifest.json

{

"name": "my-plugin",

"label": "My Plugin",

"icon": "Sparkles",

"version": "1.0.0",

"tab": {

"path": "/my-plugin",

"position": "after:skills"

},

"entry": "dist/index.js"

}

```

JS 번들 작성하기 (일반 IIFE — 빌드 단계 불필요):

```javascript

// ~/.hermes/plugins/my-plugin/dashboard/dist/index.js

(function () {

"use strict";

const SDK = window.`...`;

const { React } = SDK;

const { Card, CardHeader, CardTitle, CardContent } = SDK.components;

function MyPage() {

return React.createElement(Card, null,

React.createElement(CardHeader, null,

React.createElement(CardTitle, null, "My Plugin"),

),

React.createElement(CardContent, null,

React.createElement("p", { className: "text-sm text-muted-foreground" },

"Hello from my custom dashboard tab.",

),

),

);

}

window.`...`.register("my-plugin", MyPage);

})();

```

대시보드를 새로 고침하세요 — 탭은 내비게이션 바에서 **기술** 다음에 나타납니다.

:::tip Skip React.createElement

JSX를 선호한다면, React를 외부로 하고 IIFE 출력으로 하는 어떤 번들러(esbuild, Vite, rollup)든 사용하세요. 유일한 필수 조건은 최종 파일이 `<script>`를 통해 로드할 수 있는 단일 JS 파일이어야 한다는 것입니다. React는 절대 번들되지 않으며 `SDK.React`에서 가져옵니다.

:::

### 디렉토리 구조 {#directory-layout}

```

~/.hermes/plugins/my-plugin/

├── plugin.yaml # optional — existing CLI/gateway plugin manifest

├── __init__.py # optional — existing CLI/gateway hooks

└── dashboard/ # dashboard extension

├── manifest.json # required — tab config, icon, entry point

├── dist/

│ ├── index.js # required — pre-built JS bundle (IIFE)

│ └── style.css # optional — custom CSS

└── plugin_api.py # optional — backend API routes (FastAPI)

```

단일 플러그인 디렉토리는 세 가지 직교 확장 기능을 가질 수 있습니다:

- `plugin.yaml` + `__init__.py` — CLI/게이트웨이 플러그인 ([플러그인 페이지 보기](./plugins)).

- `dashboard/manifest.json` + `dashboard/dist/index.js` — 대시보드 UI 플러그인.

- `dashboard/plugin_api.py` — 대시보드 백엔드 경로.

그 중 어느 것도 필수는 아닙니다; 필요한 레이어만 포함하세요.

### 선적 명세서 참조 {#manifest-reference}

```json

{

"name": "my-plugin",

"label": "My Plugin",

"description": "What this plugin does",

"icon": "Sparkles",

"version": "1.0.0",

"tab": {

"path": "/my-plugin",

"position": "after:skills",

"override": "/",

"hidden": false

},

"slots": ["sidebar", "header-left"],

"entry": "dist/index.js",

"css": "dist/style.css",

"api": "plugin_api.py"

}

```

| 필드 | 필수 | 설명 |

|-------|----------|-------------|

| `name` | 예 | 고유한 플러그인 식별자. 소문자 사용, 하이픈 허용. URL 및 등록에 사용됨. |

| `label` | 예 | 탭 네비게이션에 표시되는 이름. |

| `description` | No | 간단한 설명(대시보드 관리 화면에 표시됨). |

| `icon` | No | Lucide 아이콘 이름. 기본값은 `Puzzle`입니다. 알 수 없는 이름은 `Puzzle`로 대체됩니다. |

| `version` | No | 세머버 문자열. 기본값은 `0.0.0`입니다. |

| `tab.path` | 예 | 탭의 URL 경로 (예: `/my-plugin`) |

| `tab.position` | No | 탭을 삽입할 위치. `"end"` (기본값), `"after:<path>"`, 또는 `"before:<path>"` — 콜론 다음의 값은 대상 탭의 **경로 세그먼트**입니다 (선행 슬래시 없음). 예시: `"after:skills"`, `"before:config"`. |

| `tab.override` | No | 새 탭을 추가하는 대신 해당 페이지를 **대체**하려면 내장 경로 (`"/"`, `"/sessions"`, `"/config"`,...)로 설정하세요. 자세한 내용은 [내장 페이지 대체](#replacing-built-in-pages-taboverride)를 참조하세요. |

| `tab.hidden` | No | true일 경우, 컴포넌트와 모든 슬롯을 등록하지만 nav에 탭을 추가하지 않습니다. 슬롯 전용 플러그인에서 사용됩니다. 자세한 내용은 [슬롯 전용 플러그인](#slot-only-plugins-tabhidden)을 참조하십시오. |

| `slots` | No | 이 플러그인이 채우는 명명된 셸 슬롯입니다. **문서용 보조** — 실제 등록은 JS 번들을 통해 `registerSlot()`에서 이루어집니다. 여기에 슬롯을 나열하면 검색 환경이 더 유익해집니다. |

| `entry` | 예 | `dashboard/`에 상대적인 JS 번들 경로입니다. 기본값은 `dist/index.js`입니다. |

| `css` | No | CSS 파일을 `<link>` 태그로 주입할 경로. |

| `api` | No | FastAPI 경로가 있는 Python 파일의 경로. `/api/plugins/<name>/`에 마운트됨. |

#### 사용 가능한 아이콘 {#available-icons}

플러그인은 Lucide 아이콘 이름을 사용합니다. 대시보드는 이름으로 이를 매핑하며 — 알 수 없는 이름은 조용히 `Puzzle`로 대체됩니다.

현재 매핑됨: `Activity`, `BarChart3`, `Clock`, `Code`, `Database`, `Eye`, `FileText`, `Globe`, `Heart`, `KeyRound`, `MessageSquare`, `Package`, `Puzzle`, `Settings`, `Shield`, `Sparkles`, `Star`, `Terminal`, `Wrench`, `Zap`.

다른 아이콘이 필요하신가요? `web/src/App.tsx`의 `ICON_MAP`에 PR을 열어주세요 — 순수한 추가 변경입니다.

### 플러그인 SDK {#the-plugin-sdk}

모든 플러그인에 필요한 것은 `window.`...``에 있습니다. 플러그인은 절대로 React를 직접 가져와서는 안 됩니다.

```javascript

const SDK = window.`...`;

// React + hooks

SDK.React // the React instance

SDK.hooks.useState

SDK.hooks.useEffect

SDK.hooks.useCallback

SDK.hooks.useMemo

SDK.hooks.useRef

SDK.hooks.useContext

SDK.hooks.createContext

// UI components (shadcn/ui primitives)

SDK.components.Card

SDK.components.CardHeader

SDK.components.CardTitle

SDK.components.CardContent

SDK.components.Badge

SDK.components.Button

SDK.components.Input

SDK.components.Label

SDK.components.Select

SDK.components.SelectOption

SDK.components.Separator

SDK.components.Tabs

SDK.components.TabsList

SDK.components.TabsTrigger

SDK.components.PluginSlot // render a named slot (useful for nested plugin UIs)

// Hermes API client + raw fetcher

SDK.api // typed client — getStatus, getSessions, getConfig,...

SDK.fetchJSON // raw fetch for custom endpoints (plugin-registered routes)

// Utilities

SDK.utils.cn // Tailwind class merger (clsx + twMerge)

SDK.utils.timeAgo // "5m ago" from unix timestamp

SDK.utils.isoTimeAgo // "5m ago" from ISO string

// Hooks

SDK.useI18n // i18n hook for multi-language plugins

```

#### 플러그인의 백엔드 호출 중 {#calling-your-plugins-backend}

```javascript

SDK.fetchJSON("/api/plugins/my-plugin/data").then((data) => console.log(data)).catch((err) => console.error("API call failed:", err));

``fetchJSON`은 세션 인증 토큰을 주입하고, 오류를 발생한 예외로 표시하며, JSON을 자동으로 파싱합니다.

#### 내장 Hermes 엔드포인트 호출 중 {#palette-typography-layout}

```javascript

// Agent status

SDK.api.getStatus().then((s) => console.log("Version:", s.version));

// Recent sessions

SDK.api.getSessions(10).then((resp) => console.log(resp.sessions.length));

```

전체 목록은 [웹 대시보드 → REST API](#shell-slots)를 참조하세요.

### 쉘 슬롯 {#palette-3-layer}

슬롯은 플러그인이 전체 탭을 차지하지 않고도 앱 셸의 지정된 위치 — 조종석 사이드바, 헤더, 푸터, 오버레이 레이어 — 에 컴포넌트를 주입할 수 있게 해줍니다. 여러 플러그인이 동일한 슬롯을 채울 수 있으며, 등록 순서대로 쌓여서 렌더링됩니다.

플러그인 번들 내부에서 등록하세요:

```javascript

window.`...`.registerSlot("my-plugin", "sidebar", MySidebar);

window.`...`.registerSlot("my-plugin", "header-left", MyCrest);

```

#### 슬롯 카탈로그 {#typography}

**쉘 전체 슬롯** (앱 크롬 어디에서나 렌더링 가능):

| 성 | 위치 |

|------|----------|

| `backdrop` | `<Backdrop />` 레이어 스택 안, 노이즈 레이어 위에. |

| `header-left` | 상단 바에서 에르메스 브랜드 앞에. |

| `header-right` | 상단 바의 테마/언어 전환기 전에. |